संसाधन

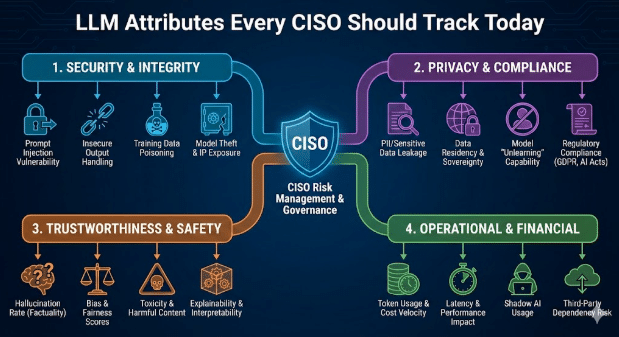

एलएलएम के वे गुण जिन्हें हर सीआईएसओ को आज ही ट्रैक करना चाहिए

सारंग वरुडकर - सीनियर टेक्निकल पीएमएम (सीएएसबी और एआई)

18 फरवरी, 2026 5 मिनट रीड

एआई उपकरण अब लेखन, विश्लेषण, मीटिंग स्वचालन और सॉफ्टवेयर विकास सहित दैनिक कार्यों को प्रभावित कर रहे हैं। इस तीव्र गति से अपनाए जाने से उत्पादकता में उल्लेखनीय वृद्धि हुई है, लेकिन साथ ही बड़े भाषा मॉडल (एलएलएम) के व्यवहार से प्रेरित एक नई सुरक्षा चुनौती भी सामने आई है। पारंपरिक SaaS जांच अब पर्याप्त नहीं हैं। CISO अब एप्लिकेशन और उसके पीछे के मॉडल दोनों का समान रूप से सावधानीपूर्वक मूल्यांकन करते हैं।

यह ब्लॉग उन एलएलएम विशेषताओं की रूपरेखा प्रस्तुत करता है जो उद्यम जोखिम को आकार देती हैं और सुरक्षा नेता उन्हें नियंत्रित करने के लिए व्यावहारिक कदम उठा सकते हैं।

एलएलएम के गुण क्यों मायने रखते हैं?

अधिकांश AI SaaS उत्पाद तृतीय-पक्ष LLM को एम्बेड करते हैं। इससे दोहरी निर्भरता उत्पन्न होती है। ऐप भले ही सभी सुरक्षा जाँचों में सफल हो जाए, लेकिन अंतर्निहित मॉडल डेटा को उजागर कर सकता है, असुरक्षित कोड उत्पन्न कर सकता है या संवेदनशील वर्कफ़्लो को लीक कर सकता है। LLM परत का स्पष्ट अवलोकन इस अंतर को दूर करता है और AI गवर्नेंस को आधुनिक खतरों के अनुरूप बनाता है।

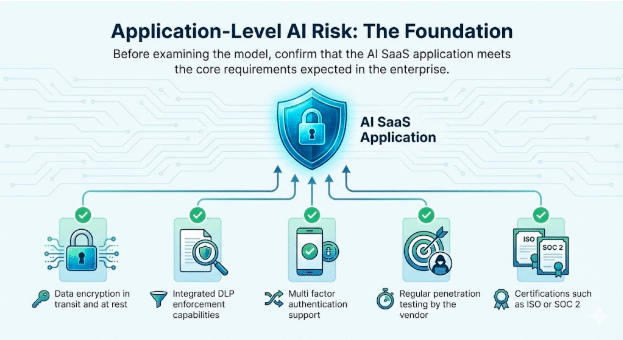

1. अनुप्रयोग-स्तर पर एआई जोखिम: आधार

मॉडल की जांच करने से पहले, यह सुनिश्चित कर लें कि एआई एसएएएस एप्लिकेशन उद्यम में अपेक्षित मुख्य आवश्यकताओं को पूरा करता है।

सत्यापन हेतु आधारभूत विशेषताएँ

- डेटा एन्क्रिप्शन, ट्रांज़िट और रेस्ट दोनों स्थितियों में।

- एकीकृत डीएलपी प्रवर्तन क्षमताएं

- मल्टी फैक्टर ऑथेंटिकेशन सपोर्ट

- विक्रेता द्वारा नियमित रूप से पेनिट्रेशन टेस्टिंग की जाती है।

- आईएसओ या एसओसी 2 जैसे प्रमाणपत्र

ये जाँचें अत्यंत आवश्यक हैं। इनसे सेवा में विश्वास स्थापित होता है और सुरक्षित एआई कार्यान्वयन की नींव तैयार होती है।

2. एलएलएम व्यवहार: नए जोखिम सतह का स्रोत

एलएलएम विशेषताएँ सीधे तौर पर प्रभावित करती हैं कि एप्लिकेशन वास्तविक उपयोगकर्ताओं और प्रतिकूल संकेतों पर कैसे प्रतिक्रिया करता है। सीआईएसओ अब प्रत्येक एम्बेडेड मॉडल में निम्नलिखित व्यवहारों पर नज़र रखते हैं।

GenAI और LLM एकीकरण

सटीक मॉडल, होस्टिंग क्षेत्र, अपडेट पैटर्न की पहचान करें और यह भी पता लगाएं कि क्या विक्रेता ग्राहक डेटा का उपयोग करके इसे बेहतर बनाता है।

जेलब्रेक का खुलासा

जेलब्रेक तब होते हैं जब उपयोगकर्ता LLM सुरक्षा नियंत्रणों को दरकिनार करने के लिए संकेतों में हेरफेर करते हैं। आम तकनीकों में रोल प्लेइंग, लेयर्ड इंस्ट्रक्शंस, काल्पनिक फ्रेमिंग और अप्रत्यक्ष या कोडित भाषा शामिल हैं। चूंकि ये इंटरैक्शन सामान्य उपयोग के समान होते हैं, इसलिए ये अक्सर बुनियादी नियंत्रणों से बच निकलते हैं। जेलब्रेक के प्रयासों पर नज़र रखने से सुरक्षा टीमों को दुरुपयोग का जल्द पता लगाने, सुरक्षा उपायों को मजबूत करने और ऑडिट के दौरान सक्रिय शासन प्रदर्शित करने में मदद मिलती है।

उदाहरण

- एक हमलावर चैटबॉट को यह समझाने के लिए मना लेता है कि ग्राहक खाते पर मल्टी-फैक्टर ऑथेंटिकेशन (MFA) को कैसे निष्क्रिय किया जाए। इससे संवेदनशील डेटा तक सीधी पहुंच खुल जाती है और एक वैध प्रतीत होने वाली कार्यप्रणाली के भीतर पहचान सुरक्षा भंग हो जाती है।

मैलवेयर और हानिकारक कोड जनरेशन

एलएलएम कभी-कभी ऐसा कोड तैयार करते हैं जिसमें छिपे हुए निष्पादन पथ या डेटा चोरी करने के रूटीन शामिल होते हैं।

उदाहरण

- एक इंजीनियर एआई द्वारा सुझाए गए कोड को एक आंतरिक सेवा में पेस्ट करता है। इस कोड में गुप्त रूप से डेटा लीक होता है। इससे एक अनजाने उल्लंघन को अंजाम दिया जाता है क्योंकि कोड का तर्क वैध प्रतीत होता है।

विषाक्तता, पूर्वाग्रह और सीबीआरएन उत्सर्जन जोखिम

संवेदनशील या प्रतिकूल संकेतों के सामने आने पर मॉडल असुरक्षित पाठ उत्पन्न कर सकते हैं। उन व्यावसायिक इकाइयों के लिए इन व्यवहारों पर नज़र रखें जहाँ सुरक्षा, अनुपालन या भौतिक जोखिम का मामला शामिल है।

उदाहरण

- विषाक्तता: एक आंतरिक सहायता चैटबॉट, शत्रुतापूर्ण संकेतों के बाद, ग्राहक की गंभीर शिकायत का अपमानजनक या धमकी भरी भाषा में जवाब देता है, जिससे ट्रांसक्रिप्ट के लॉग होने या साझा किए जाने पर मानव संसाधन और ब्रांड के लिए जोखिम पैदा होता है।

- पूर्वाग्रह: एक भर्ती टीम उम्मीदवारों को रैंक देने के लिए एलएलएम का उपयोग करती है, और यह मॉडल लगातार लिंग या जाति संकेतकों वाली प्रोफाइल को कमतर आंकता है, जिससे संगठन भेदभाव और ऑडिट निष्कर्षों के लिए उजागर होता है।

- सीबीआरएन उत्सर्जन जोखिम: एक अनुसंधान एवं विकास उपयोगकर्ता एक एलएलएम से एक रासायनिक प्रक्रिया में सुधार के बारे में पूछता है, और मॉडल चरण-दर-चरण मार्गदर्शन लौटाता है जो प्रतिबंधित रासायनिक संश्लेषण के अनुरूप होता है, जिससे नियामक और भौतिक सुरक्षा जोखिम उत्पन्न होता है।

NIST और OWASP LLM दिशानिर्देशों के साथ संरेखण

NIST ने एक जनरेटिव AI प्रोफाइल जारी किया है जो जिम्मेदार AI जोखिम प्रबंधन के लिए तेजी से आधारभूत मानक बनता जा रहा है। सुरक्षा और अनुपालन टीमें अब प्रत्येक LLM आधारित एप्लिकेशन से इन अपेक्षाओं के अनुरूप स्पष्ट रूप से मैप करने की उम्मीद करती हैं।

कंपनियां सीधे सवाल पूछ रही हैं

- कृत्रिम बुद्धिमत्ता के उपयोग और उसके परिणामों के लिए कौन जवाबदेह है?

- एलएलएम के किन उपयोग मामलों की स्पष्ट रूप से अनुमति है या किन पर प्रतिबंध है?

- क्या प्रशिक्षण और फाइन ट्यूनिंग डेटा को पारदर्शी रूप से घोषित किया जाता है?

- शीघ्र इंजेक्शन, मतिभ्रम और अनधिकृत डेटा एक्सेस जैसे जोखिमों से कैसे निपटा जाता है

जब इन सवालों के स्पष्ट जवाब नहीं मिलते, तो ऑडिट का जोखिम तेज़ी से बढ़ जाता है। स्वास्थ्य सेवा और वित्तीय सेवाओं जैसे विनियमित क्षेत्रों में, NIST के दिशानिर्देशों का पालन न करने से डेटा लीक होने, नियामक दंड लगने और ऑडिट विफल होने की संभावना बढ़ जाती है।

इसके साथ ही, OWASP टॉप 10 फॉर एलएलएम एप्लीकेशंस दस्तावेज़ में कमजोरियों के एक नए वर्ग का उल्लेख किया गया है जो पारंपरिक एप्लिकेशन सुरक्षा चिंताओं से परे हैं। इनमें प्रॉम्प्ट इंजेक्शन, असुरक्षित आउटपुट हैंडलिंग, ट्रेनिंग डेटा पॉइज़निंग और असुरक्षित एकीकरण शामिल हैं।

वास्तविक घटनाएं पहले से ही इन जोखिमों को दर्शाती हैं। एक मामले में, एक SaaS एप्लिकेशन ने उपयोगकर्ताओं को AI प्रोसेसिंग के लिए दस्तावेज़ अपलोड करने की अनुमति दी। एक हमलावर ने फ़ाइल के अंदर छिपे हुए निर्देश डाल दिए, मॉडल ने उन्हें निष्पादित किया, और कंपनी का संवेदनशील डेटा लीक हो गया। ये स्थितियाँ लाइव प्रोडक्शन वातावरण में घटित हो रही हैं, और जो संगठन सक्रिय रूप से इन पर नज़र नहीं रखते और इन्हें कम नहीं करते, उन्हें गंभीर सुरक्षा जोखिम का सामना करना पड़ता है।

उदाहरण

- आउटपुट वैलिडेशन के बिना एक मॉडल प्रॉम्प्ट इंजेक्शन के प्रयास के दौरान एडमिन कुंजी लीक कर देता है। इससे मजबूत ऐप-स्तरीय नियंत्रणों के बावजूद सिस्टम में व्यापक सेंधमारी हो जाती है।

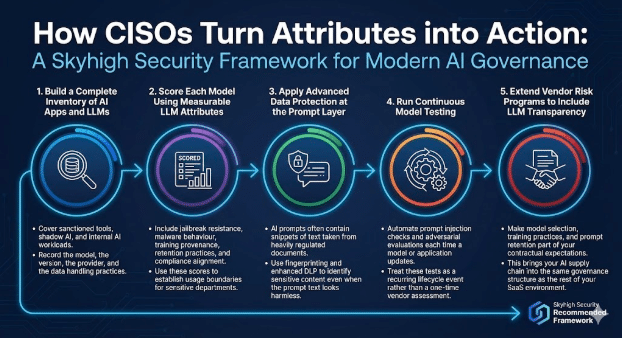

सीआईएसओ इन गुणों को कार्रवाई में कैसे बदलते हैं

एक आधुनिक एआई गवर्नेंस प्रोग्राम एप्लिकेशन चेक को मॉडल-अवेयर कंट्रोल के साथ एकीकृत करता है।

Skyhigh Security निम्नलिखित फ्रेमवर्क की अनुशंसा करती है।

1. एआई ऐप्स और एलएलएम की पूरी सूची तैयार करें

स्वीकृत उपकरणों, शैडो एआई और आंतरिक एआई वर्कलोड को कवर करें।

मॉडल, संस्करण, प्रदाता और डेटा प्रबंधन प्रक्रियाओं को रिकॉर्ड करें।

2. मापने योग्य एलएलएम विशेषताओं का उपयोग करके प्रत्येक मॉडल को स्कोर करें

जेलब्रेक प्रतिरोध, मैलवेयर व्यवहार, प्रशिक्षण स्रोत, प्रतिधारण प्रक्रियाएं और अनुपालन संरेखण को शामिल करें। संवेदनशील विभागों के लिए उपयोग सीमाएं निर्धारित करने के लिए इन स्कोरों का उपयोग करें।

3. प्रॉम्प्ट लेयर पर उन्नत डेटा सुरक्षा लागू करें

एआई प्रॉम्प्ट में अक्सर कड़े नियमों वाले दस्तावेज़ों से लिए गए पाठ के अंश होते हैं। फिंगरप्रिंटिंग और उन्नत डीएलपी का उपयोग करके संवेदनशील सामग्री की पहचान करें, भले ही प्रॉम्प्ट का पाठ हानिरहित प्रतीत हो।

4. निरंतर मॉडल परीक्षण चलाएँ

मॉडल या एप्लिकेशन अपडेट होने पर हर बार प्रॉम्प्ट इंजेक्शन जांच और एडवर्सरियल मूल्यांकन को स्वचालित करें। इन परीक्षणों को विक्रेता के एक बार के मूल्यांकन के बजाय एक आवर्ती जीवनचक्र घटना के रूप में मानें।

5. विक्रेता जोखिम कार्यक्रमों का विस्तार करके उसमें एलएलएम पारदर्शिता को शामिल करें।

मॉडल चयन, प्रशिक्षण प्रक्रियाओं और त्वरित प्रतिधारण को अपने अनुबंध की अपेक्षाओं का हिस्सा बनाएं। इससे आपकी एआई आपूर्ति श्रृंखला आपके शेष SaaS वातावरण के समान शासन संरचना में आ जाएगी।

आगे का रास्ता

एलएलएम (लॉन्ग-लेवल लर्निंग) कार्यक्रम उद्यमों द्वारा एआई के उपयोग के तरीके को नया रूप देते हैं, और वे सीआईएसओ (कंज्यूमर सर्विस ऑफिसर) द्वारा जोखिम के मूल्यांकन के तरीके को भी नया रूप देते हैं।

परंपरागत एप्लिकेशन गवर्नेंस में, सुरक्षा टीमें दो मुख्य बातों को अलग-अलग रखती हैं। एप्लिकेशन को एक्सेस कंट्रोल, डेटा सुरक्षा, लॉगिंग और अनुपालन के लिए एंटरप्राइज़ मानकों को पूरा करना होगा। इसके अलावा, अंतर्निहित प्लेटफ़ॉर्म को विश्वसनीयता, सुरक्षा और परिचालन संबंधी अपेक्षाओं को पूरा करना होगा।

एलएलएम में भी दो स्तरीय जिम्मेदारियां होती हैं, लेकिन इस बार जोखिम अधिक होता है।

- एप्लिकेशन स्तर पर, संगठनों को यह नियंत्रित करना होगा कि AI सुविधाओं को उपयोगकर्ताओं के सामने कैसे प्रस्तुत किया जाए। इसमें यह शामिल है कि कौन इस क्षमता का उपयोग कर सकता है, कौन सा डेटा सबमिट किया जा सकता है, आउटपुट कैसे साझा किए जाते हैं, और ऑडिट और जांच के लिए गतिविधि को कैसे लॉग किया जाता है। ये नियंत्रण परिचित एप्लिकेशन सुरक्षा प्रथाओं को दर्शाते हैं, जिन्हें AI-संचालित वर्कफ़्लो में विस्तारित किया गया है।

- मॉडल स्तर पर, CISO को यह आकलन करना होगा कि वास्तविक परिस्थितियों में LLM कैसा व्यवहार करता है। इसमें यह शामिल है कि मॉडल संवेदनशील संकेतों को कैसे संभालता है, क्या यह असुरक्षित या पक्षपातपूर्ण परिणाम देता है, यह डेटा को कैसे सहेजता है या उसका पुन: उपयोग करता है, और यह संकेत इंजेक्शन या डेटा विषाक्तता जैसे दुरुपयोग के प्रति कितना प्रतिरोधी है। ये व्यवहार पारंपरिक ऐप परीक्षण से बाहर हैं और इनके लिए स्पष्ट नियंत्रण की आवश्यकता होती है।

डेटा उपयोग, सुरक्षा व्यवहार, सुरक्षा उपायों का दायरा और विफलता पैटर्न जैसे एलएलएम विशेषताओं को ट्रैक करने से सुरक्षा प्रमुखों को वही भरोसा मिलता है जो वे परिपक्व एप्लिकेशन प्रोग्राम से उम्मीद करते हैं। इस पारदर्शिता के साथ, सीआईएसओ व्यापक एआई अपनाने में सहायता कर सकते हैं, साथ ही पूरे उद्यम में सुरक्षा, गोपनीयता और नियामक प्रतिबद्धताओं को बनाए रख सकते हैं।

लेखक के बारे में

सारंग वरुडकर

सीनियर टेक्निकल पीएमएम

सारंग वरुडकर एक अनुभवी उत्पाद विपणन प्रबंधक हैं, जिनके पास साइबर सुरक्षा में 10+ वर्षों का अनुभव है, तथा वे तकनीकी नवाचार को बाजार की जरूरतों के साथ जोड़ने में कुशल हैं। वे CASB, DLP, तथा AI-संचालित खतरे का पता लगाने जैसे समाधानों में गहन विशेषज्ञता रखते हैं, तथा प्रभावशाली बाजार-उन्मुख रणनीतियों और ग्राहक जुड़ाव को आगे बढ़ाते हैं। सारंग के पास IIM बैंगलोर से MBA तथा पुणे विश्वविद्यालय से इंजीनियरिंग की डिग्री है, जो तकनीकी और रणनीतिक अंतर्दृष्टि को जोड़ती है।

संबंधित सामग्री

ट्रेंडिंग ब्लॉग

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Sarang Warudkar and Stuart Bayliss April 30, 2026

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Nick LeBrun April 23, 2026

Skyhigh Security Achieves BSI C5 Certification, Bringing the Full SSE Portfolio to the German Market

Stuart Bayliss and Sarang Warudkar April 16, 2026

RSAC 2026: परिचालन संबंधी आवश्यकता के रूप में एआई सुरक्षा

त्याग वासुदेवन 3 अप्रैल, 2026

डीएसपीएम का डेजा वू: हम शैडो आईटी के कागज़ी कवच का पुनर्निर्माण क्यों कर रहे हैं?

टोनी फ्रम 19 मार्च, 2026