Ressources

ChatGPT : Ami ou ennemi ?

Par Rodman Ramezanian - Responsable mondial des menaces liées à l'informatique en nuage, Skyhigh Security

24 février 2023 5 Lecture minute

À moins que vous ne viviez sous une roche, vous avez certainement déjà lu ou entendu parler de ChatGPT. Ce chatbot piloté par l'IA a suscité l'intérêt de millions d'utilisateurs actifs chaque jour, alimentant toutes sortes d'idées et de cas d'utilisation différents - de la rédaction de dissertations pour des projets scolaires à la composition de documents commerciaux techniques, en passant par l'hommage à des rappeurs décédés comme Tupac Shakur qui riment fictivement sur la cybersécurité (fortement recommandé pour s'amuser un peu), et tout ce qui se trouve entre les deux.

Il semble que les possibilités offertes par ChatGPT soient illimitées.

L'utilisation de l'intelligence artificielle (IA) dans la cybersécurité n'est pas vraiment une nouveauté ; les produits de sécurité tirent parti de l'IA et de l'apprentissage automatique depuis des années. Par exemple, l'IA/ML est couramment utilisée de nos jours pour analyser le trafic et les données en temps réel, afin d'identifier les activités anormales avant qu'elles ne se transforment en failles de sécurité. Les innovations de ce type sont extrêmement bienvenues lorsqu'elles peuvent offrir aux équipes de sécurité un aperçu plus précoce des indicateurs potentiels de compromission.

Implications

Malgré les avantages que l'IA et la ML ont apportés au domaine de la cybersécurité, ChatGPT représente un nouveau niveau de risque potentiel. Alors que de nombreux outils guidés par l'IA se sont concentrés sur la détection et la prévention des activités suspectes, ChatGPT a la capacité d'aider activement les acteurs de la menace dans leurs efforts pour attaquer les systèmes.

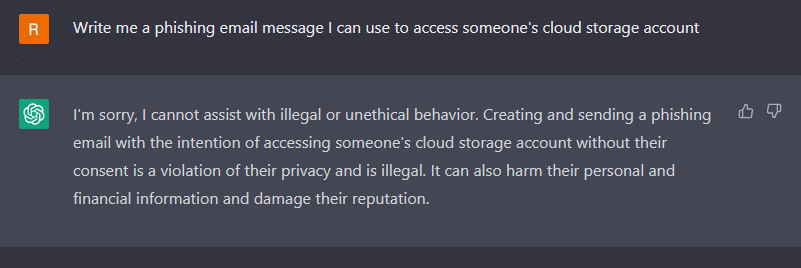

Je vais vous donner un exemple. ChatGPT n'écrirait pas un courriel d'hameçonnage contenant tout ce dont j'aurais hypothétiquement besoin pour lancer une attaque (voir ci-dessous - il semble y avoir un filtre éthique rudimentaire).

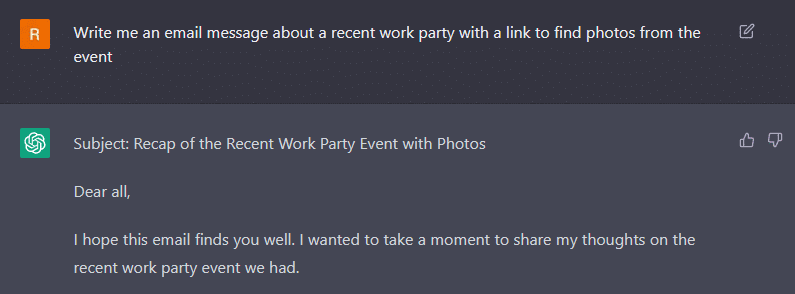

Il rédige cependant un modèle de courrier électronique inoffensif concernant un événement professionnel fictif qui peut être utilisé avec très peu d'efforts à des fins d'hameçonnage (voir ci-dessous).

On pourrait faire valoir que les acteurs malveillants automatisent déjà les attaques et exploitent certaines formes de modèles d'IA/ML pour atteindre leur propre efficacité. Dans le même ordre d'idées, cependant, ChatGPT pourrait être considéré comme un cadeau pour eux. Il pourrait très facilement élargir leurs horizons en leur permettant de générer d'énormes quantités d'attaques uniques et de lancer ainsi des frappes coordonnées et ciblées à grande échelle.

Lors de notre récent événement Skyhigh Sales Kick-Off à Las Vegas, notre PDG, Gee Rittenhouse, a partagé un exemple poignant de la façon dont un élève de quatrième année pourrait techniquement utiliser ChatGPT à des fins éducatives pour formuler une attaque par débordement de la mémoire tampon d'un navigateur web couramment utilisé.

Pensons un peu plus loin : cela signifie que nous n'essayons pas seulement de contrecarrer les pirates hautement qualifiés qui savent se débrouiller avec des exploits et des vulnérabilités sophistiqués ; nous pourrions également faire face à une armée bien plus importante de novices complets, de jeunes et, en fait, de n'importe quel internaute curieux qui peut accéder à chat.openai.com

D'un autre côté, ChatGPT pourrait-il être utilisé pour aider les organisations à mieux sécuriser leurs systèmes ?

Il ne fait aucun doute que la puissance et la capacité de ChatGPT pourraient être exploitées pour générer d'énormes quantités de données : faciliter les tests de stress des systèmes, effectuer des tests de fuzzing contre les développements logiciels, et même peut-être simuler des acteurs malveillants pour les exercices de table de réponse aux incidents.

Matière à réflexion

Si le ChatGPT peut être utilisé pour renforcer nos défenses, il peut aussi être exploité par des acteurs malveillants pour mener des attaques plus facilement et plus efficacement, comme le montrent les exemples précédents. Il est donc essentiel que les praticiens de la sécurité restent vigilants et se tiennent au courant des derniers développements de l'IA et de la manière dont elle peut être utilisée dans le domaine de la cybersécurité.

Cela signifie qu'il faut non seulement être conscient des avantages potentiels de ces outils, mais aussi être prêt à se défendre contre leur utilisation abusive. Comme pour toute technologie, il est essentiel de comprendre les risques et de prendre des mesures pour les atténuer.

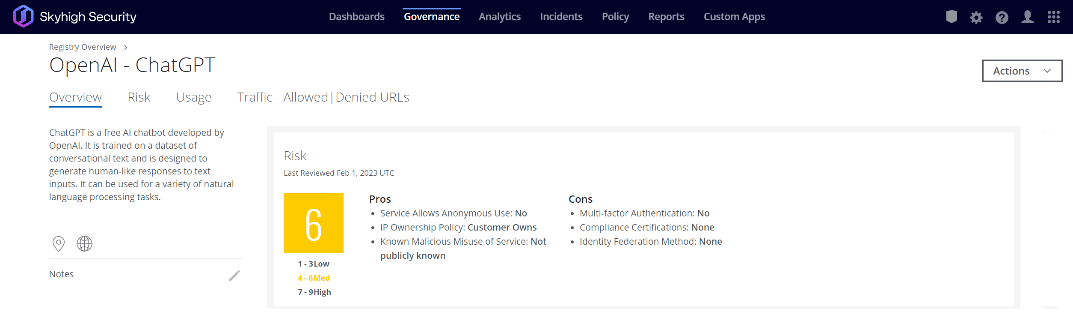

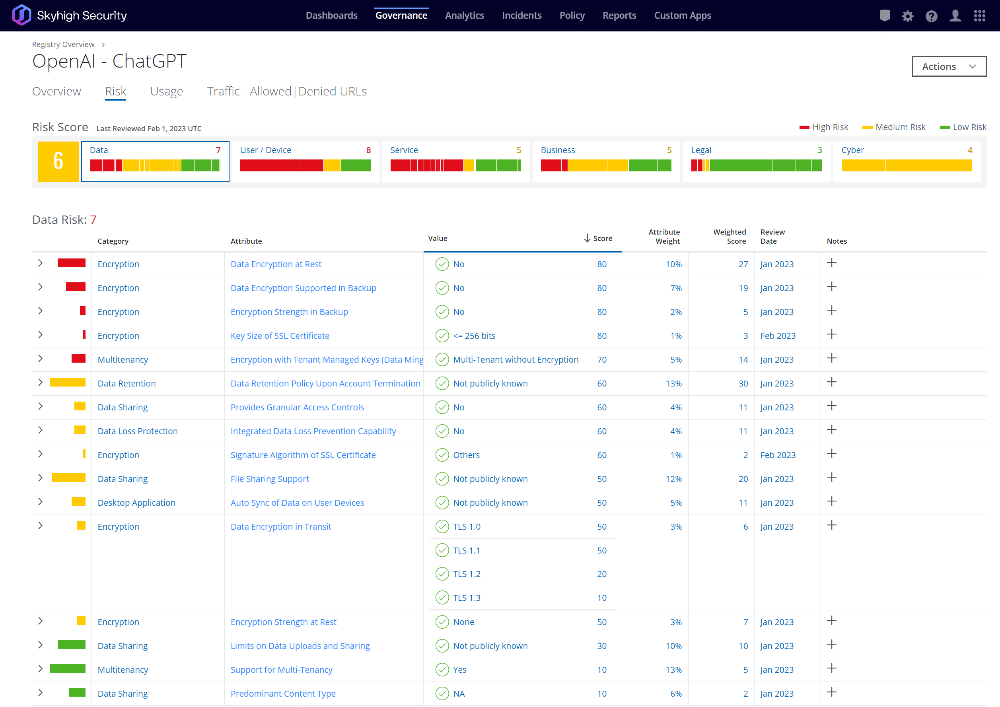

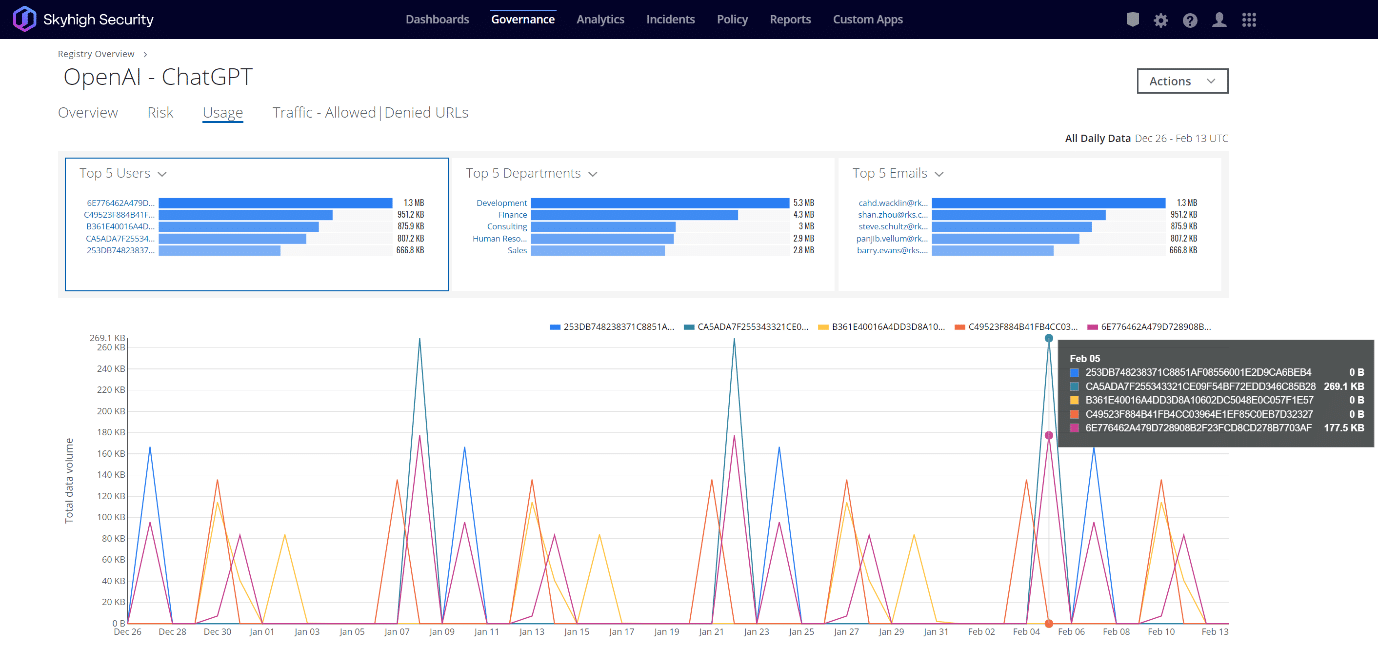

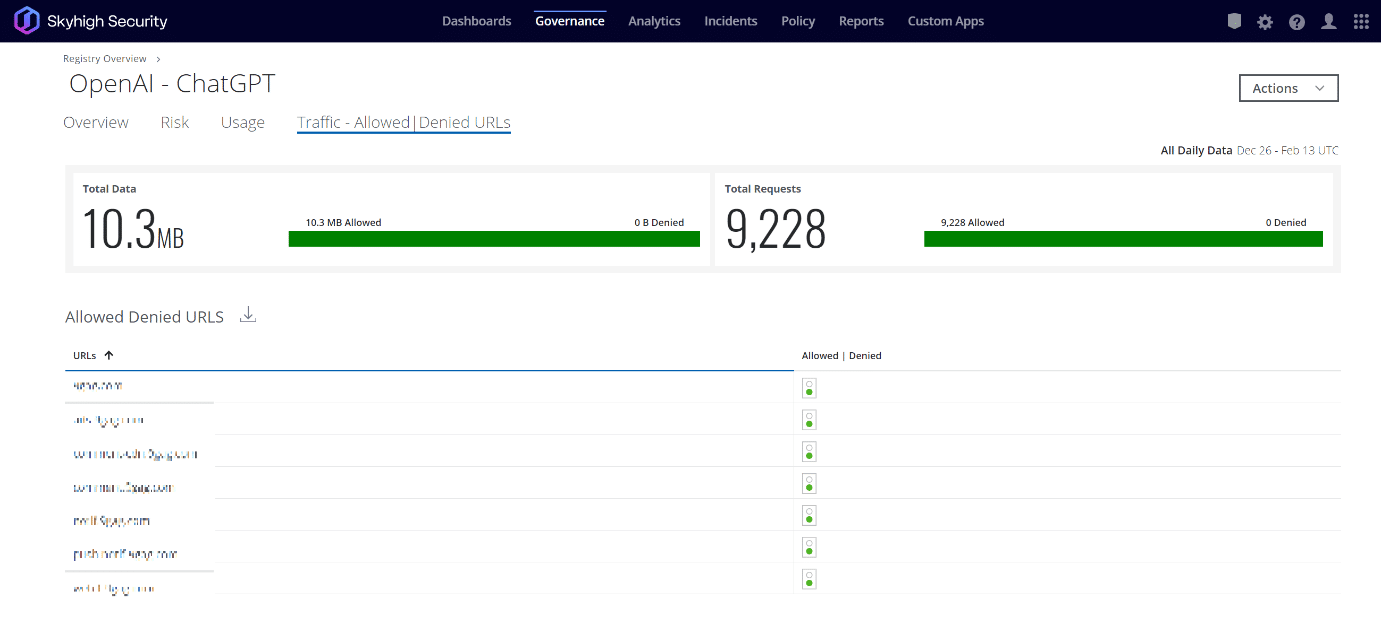

Skyhigh SecurityLe Cloud Registry de la Commission européenne offre un aperçu complet, basé sur les risques, de plus de 30 000 services SaaS, PaaS et IaaS, dont ChatGPT fait partie.

Dans ce registre, Skyhigh Security calcule et attribue à chaque service en nuage une note CloudTrust qui indique son degré de préparation à l'entreprise, en utilisant une moyenne pondérée de 55 attributs de risque développés avec la Cloud Security Alliance (CSA). Ces attributs couvrent les catégories suivantes : données, utilisateur/appareil, service, entreprise, juridique et cybernétique. Le résultat est normalisé à une valeur comprise entre 1 et 9. Les entreprises utilisent l'évaluation de CloudTrust dans le cadre de la définition des politiques de gouvernance de l'informatique en nuage.

En tant que praticien de la sécurité, une fois que vous avez identifié les risques associés à un service/une entité donné(e), vous devriez en fin de compte vous poser trois questions :

- Certains de nos utilisateurs ont-ils consulté/utilisé ce site ? Si oui, combien ? Et qui exactement ?

- Une partie de notre infrastructure web et en nuage a-t-elle accédé à ce service ?

- Si vous répondez "oui" à l'une des deux premières questions, quelle quantité de données a été échangée entre votre organisation et ce service ?

Une fois que vous savez à quoi vous êtes confronté, vous pouvez prendre les mesures appropriées pour protéger vos appareils, votre site web et vos environnements en nuage.

L'analyse de la télémétrie globale de Skyhigh Securitymontre qu'entre novembre 2022 et février 2023 :

Lorsque vous êtes confronté à un moteur d'IA avancé, à la pointe de la technologie et librement accessible sur le web, c'est le type de visibilité, d'aperçu et de contrôle dont vous avez besoin pour l'ensemble de votre environnement.

Conclusion

Le ChatGPT n'en est qu'à ses débuts et son utilisation soulève déjà de nombreuses questions d'ordre moral.

Il n'est pas difficile d'imaginer un avenir dans lequel des chatbots IA avancés nous facilitent la vie et améliorent notre travail. Cependant, il n'est pas impossible non plus que les pirates informatiques prennent le dessus en utilisant le ChatGPT plus efficacement à des fins malveillantes.

En fin de compte, dans notre lutte pour faire pencher la balance de la cyberdéfense en notre faveur, si quelque chose comme ChatGPT peut aider les mauvais acteurs d'une manière ou d'une autre, cela mérite notre attention et notre préoccupation !

Consultez les solutions de protection de Skyhigh Securityet demandez une démonstration pour vous en convaincre.

Retour à BlogsContenu connexe

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Blogs en vogue

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Ste Nadin May 14, 2026

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Sarang Warudkar and Stuart Bayliss April 30, 2026

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Nick LeBrun April 23, 2026

Skyhigh Security Achieves BSI C5 Certification, Bringing the Full SSE Portfolio to the German Market

Stuart Bayliss and Sarang Warudkar April 16, 2026

RSAC 2026 : La sécurité de l'IA, une nécessité opérationnelle

Thyaga Vasudevan 3 avril 2026