Recursos

ChatGPT: ¿Amigo o enemigo?

Por Rodman Ramezanian - Global Cloud Threat Lead, Skyhigh Security

24 de febrero de 2023 5 Minuto de lectura

A menos que haya estado viviendo bajo una roca, seguramente ya habrá leído u oído hablar de ChatGPT. Este chatbot impulsado por la IA ha despertado el interés de millones de usuarios activos al día, alimentando todo tipo de ideas y casos de uso diferentes: desde escribir redacciones para proyectos escolares, hasta componer documentos técnicos de negocios, incluso rendir homenaje a raperos fallecidos como Tupac Shakur rimando ficticiamente sobre ciberseguridad (muy recomendable para divertirse un rato), y todo lo demás.

Parece que las posibilidades con ChatGPT son ilimitadas.

El uso de la Inteligencia Artificial (IA) en la ciberseguridad no es exactamente novedoso; los productos de seguridad han aprovechado la IA y el Aprendizaje Automático (AM) desde hace años. Por ejemplo, la IA/ML se utiliza comúnmente hoy en día para analizar el tráfico y los datos en tiempo real, en última instancia para identificar actividades anómalas antes de que se conviertan en brechas de seguridad. Este tipo de innovaciones son muy bienvenidas cuando pueden ofrecer a los equipos de seguridad una visión más temprana de los posibles indicadores de compromiso.

Implicaciones

A pesar de los beneficios que la IA y el ML han aportado al ámbito de la ciberseguridad, ChatGPT representa un nuevo nivel de riesgo potencial. Mientras que muchas herramientas guiadas por IA se han centrado en detectar y prevenir actividades sospechosas, ChatGPT tiene la capacidad de ayudar activamente a los actores de amenazas en sus esfuerzos por atacar los sistemas.

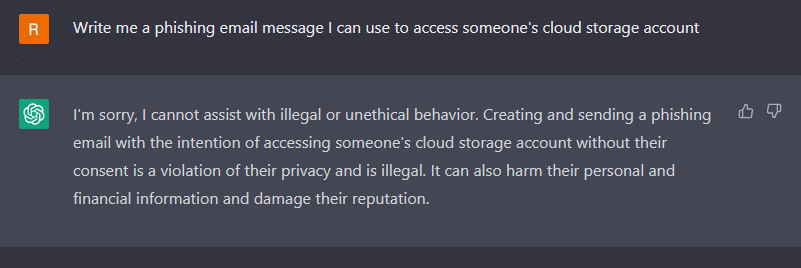

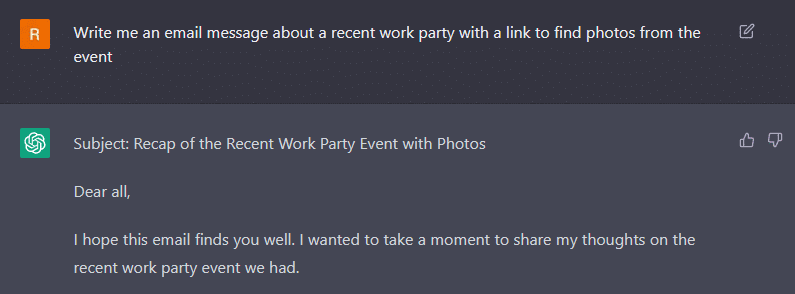

Lo demostraré con un ejemplo. ChatGPT no escribiría realmente un correo electrónico de phishing con todo lo que hipotéticamente necesitaría para lanzar un ataque (véase más abajo - parece que hay un filtro ético rudimentario).

Sin embargo, escribiría una plantilla de correo electrónico inocua relativa a un evento de trabajo ficticio que se podría convertir en un arma con muy poco esfuerzo para fines de suplantación de identidad (a continuación)

Ahora bien, se podría argumentar que los actores maliciosos ya automatizan los ataques y aprovechan algunas formas de modelos de IA/ML para lograr sus propias eficiencias retorcidas. Siguiendo esa misma línea de pensamiento, sin embargo, ChatGPT podría verse como una especie de regalo para ellos. Podría ampliar muy fácilmente sus horizontes al permitirles generar enormes cantidades de ataques únicos, lanzando así ataques coordinados y selectivos a gran escala.

En nuestro reciente evento Skyhigh Sales Kick-Off en Las Vegas, nuestro CEO, Gee Rittenhouse, compartió un ejemplo desgarrador de cómo un estudiante de cuarto grado podría técnicamente utilizar ahora ChatGPT con fines educativos para formular un ataque de desbordamiento de búfer para un navegador web de uso común.

Pensando en el panorama general por un segundo aquí: eso significa que no sólo estamos tratando de frustrar a los hackers altamente cualificados que conocen su camino alrededor de sofisticados exploits y vulnerabilidades; potencialmente ahora también podríamos enfrentarnos a un ejército mucho mayor de completos novatos, jóvenes y básicamente cualquier usuario curioso de la web que pueda llegar a chat.openai.com

Por otro lado, ¿podría utilizarse ChatGPT para ayudar a las organizaciones a proteger mejor sus sistemas?

No cabe duda de que la potencia y la capacidad de ChatGPT podrían aprovecharse para generar enormes cantidades de datos: facilitar las pruebas de estrés del sistema, realizar pruebas de fuzzing contra los desarrollos de software e incluso, tal vez, simular actores maliciosos para ejercicios de mesa de respuesta a incidentes.

Para reflexionar

Aunque la ChatGPT puede utilizarse para reforzar nuestras defensas, también puede ser explotada por actores repugnantes para llevar a cabo ataques con mayor facilidad y eficacia, como muestran los ejemplos anteriores. Por lo tanto, es esencial que los profesionales de la seguridad se mantengan alerta y al día de los últimos avances en IA y de cómo puede utilizarse en el ámbito de la ciberseguridad.

Esto significa no sólo ser consciente de los beneficios potenciales de estas herramientas, sino también estar preparado para defenderse de su posible uso indebido. Como con cualquier tecnología, es crucial comprender los riesgos y tomar medidas para mitigarlos.

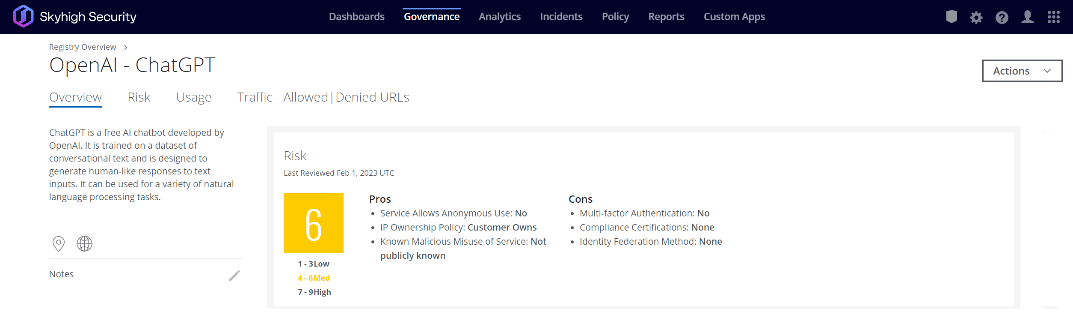

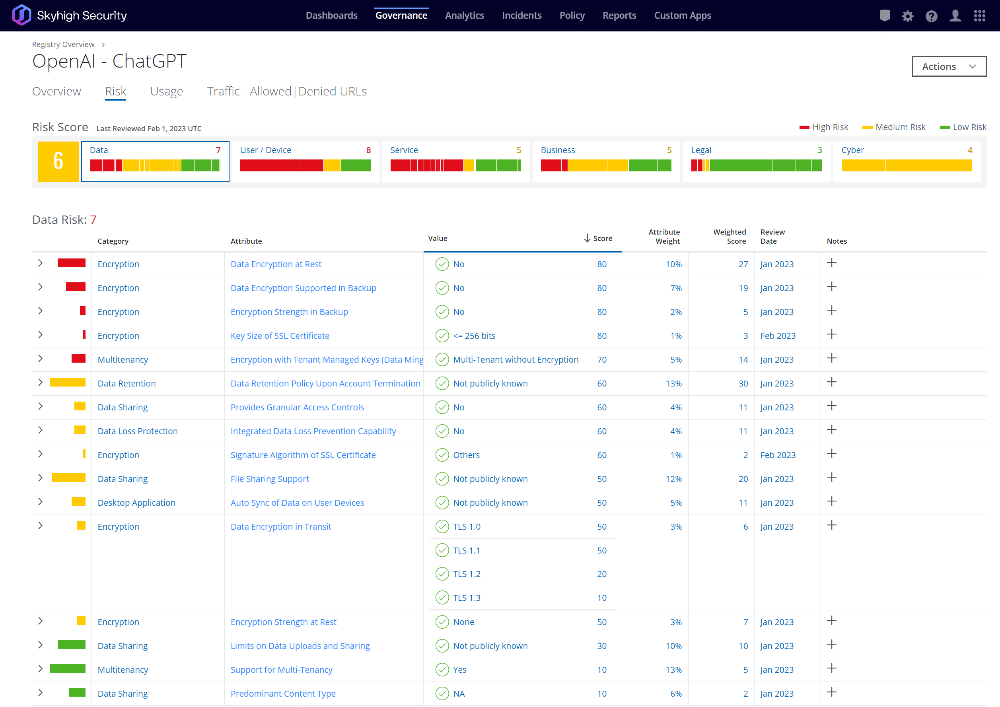

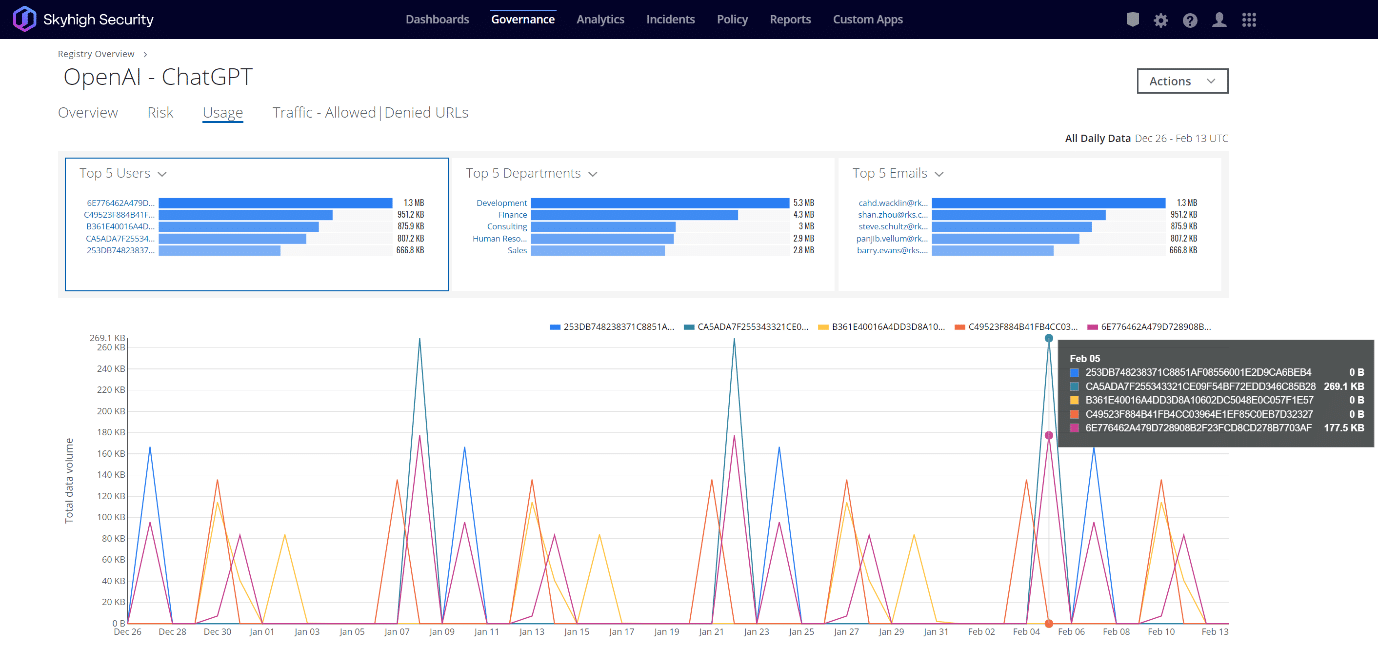

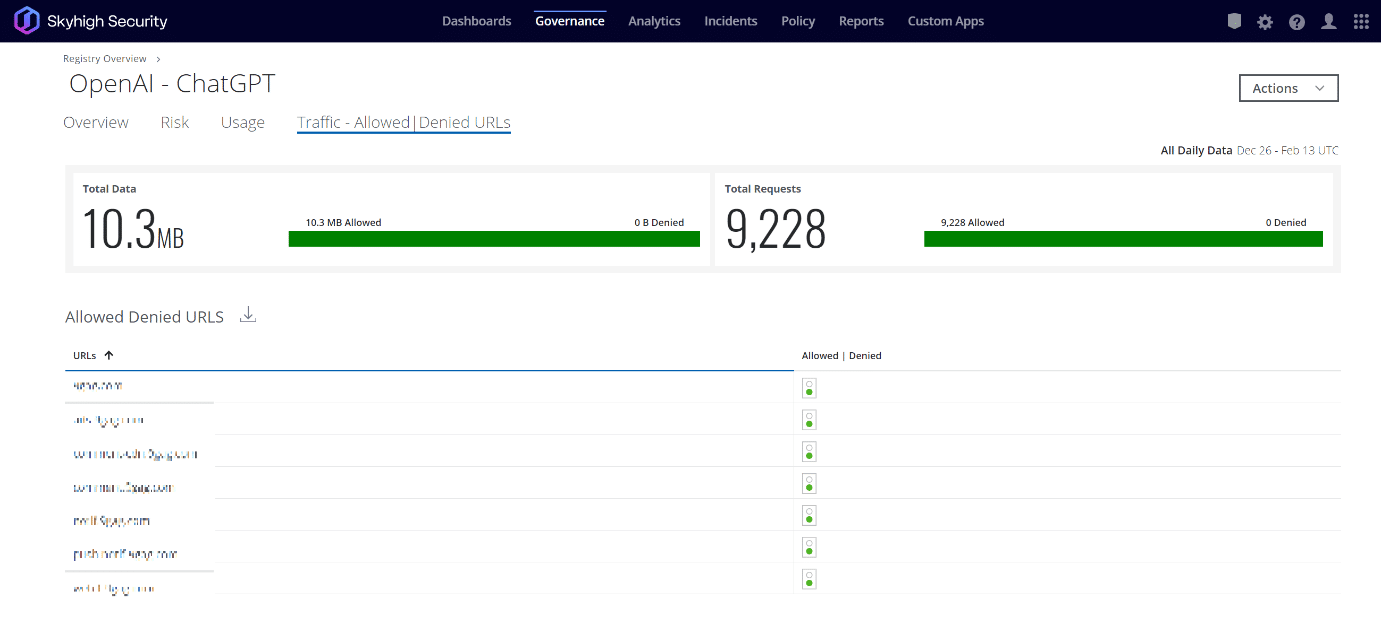

Skyhigh Security's Cloud Registry ofrece una visión exhaustiva basada en riesgos de más de 30.000 servicios SaaS, PaaS e IaaS, siendo ChatGPT sólo uno de ellos.

Dentro de este Registro de Nube, Skyhigh Security calcula y asigna a cada servicio en nube una calificación CloudTrust que indica su preparación para la empresa, utilizando una media ponderada de 55 Atributos de Riesgo desarrollados con la Cloud Security Alliance (CSA). Estos atributos abarcan las categorías de datos, usuarios/dispositivos, servicios, negocios, legal y cibernética. Normaliza el resultado a un valor entre 1 y 9. Las empresas utilizan la calificación CloudTrust como parte de la definición de las políticas de gobernanza de la nube.

Como profesional de la seguridad, una vez que haya identificado los riesgos asociados de un determinado servicio/entidad, en última instancia querrá hacerse tres preguntas:

- ¿Alguno de nuestros usuarios ha navegado/utilizado esto? En caso afirmativo, ¿cuántos? ¿Y quién exactamente?

- ¿Alguna parte de nuestra infraestructura web y en la nube ha accedido a este servicio?

- Y si alguna de las dos primeras preguntas da como resultado un "sí", ¿cuántos datos se han transmitido entre su organización y ese servicio?

Una vez que sepa a qué se enfrenta, podrá tomar las medidas adecuadas para proteger sus dispositivos, la web y los entornos en la nube.

Del análisis de la telemetría global de Skyhigh Security, vemos que entre noviembre de 2022 y febrero de 2023:

Cuando se enfrenta a un motor de IA avanzado y puntero que está disponible gratuitamente en la web, éste es el tipo de visibilidad, conocimiento y control que necesita en todo su entorno.

Para terminar

El ChatGPT aún está en pañales y ya hay muchas cuestiones morales que considerar con su uso.

No es difícil imaginar un futuro en el que los chatbots de IA avanzada nos faciliten la vida y mejoren nuestro trabajo. Sin embargo, tampoco es imposible que los piratas informáticos se adelanten en el uso más eficaz de ChatGPT con fines nefastos.

En última instancia, sin embargo, en nuestra lucha por inclinar la balanza de la ciberdefensa a nuestro favor, si algo como ChatGPT puede ayudar a los malos actores de alguna manera, forma o manera, ¡merece nuestra atención y preocupación!

Consulte las soluciones de protección de Skyhigh Securityy solicite una demostración para comprobarlo usted mismo.

Volver a BlogsContenido relacionado

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Blogs de moda

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Ste Nadin May 14, 2026

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Sarang Warudkar and Stuart Bayliss April 30, 2026

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Nick LeBrun April 23, 2026

Skyhigh Security Achieves BSI C5 Certification, Bringing the Full SSE Portfolio to the German Market

Stuart Bayliss and Sarang Warudkar April 16, 2026

RSAC 2026: La seguridad de la IA como necesidad operativa

Thyaga Vasudevan 3 de abril de 2026