Recursos

Adopte ChatGPT sin poner en riesgo los datos críticos de su empresa

Por Tony Frum - Especialista en productos, Skyhigh Security

6 de junio de 2023 6 Minuto de lectura

Habiendo crecido sabiendo utilizar un teléfono de disco, he visto bastantes avances tecnológicos a lo largo de mis años. Sin embargo, creo que puede palidecer en comparación con lo que verán mis hijos en su vida debido a la llegada de la Inteligencia Artificial (IA). Los expertos en la materia utilizan comparaciones exageradas como la bomba atómica y el descubrimiento del fuego para describir su importancia, y hay bastantes posibilidades de que no sean exageraciones.

Existe una gran consternación en torno a este desarrollo y algunos piden medidas de seguridad, regulaciones gubernamentales e incluso una moratoria en la investigación de la IA. En el campo de la ciberseguridad, existe una gran ansiedad en relación con el uso de herramientas de IA como ChatGPT y sus implicaciones para la seguridad de los datos. Como proveedor de Security Service Edge (SSE) maniáticamente centrado en los datos, en Skyhigh Security nos preguntan al menos a diario sobre cómo puede evitarse la pérdida de datos a través de ChatGPT. Nuestros clientes leen sobre situaciones como el incidente de pérdida de datos de Samsung a través de ChatGPT y quieren asegurarse de que disponen de los controles adecuados.

A pesar de la novedad de herramientas como ChatGPT, tengo que resistir el impulso de citar al Eclesiastés diciendo: "No hay nada nuevo bajo el sol". Aunque el riesgo específico de que un modelo de IA se entrene con sus datos puede ser un giro nuevo, la logística de proteger sus datos de ChatGPT no es en realidad nada nuevo. Es lo que hacemos todos los días. Y, para decirlo sin rodeos, si dispone de los controles de seguridad de datos adecuados, entonces ya debería tener las bases cubiertas. Repasemos brevemente los controles aplicables, muchos de los cuales probablemente ya tenga desplegados, y cómo pueden ayudarle a hacer frente a este nuevo, pero no tan nuevo, riesgo.

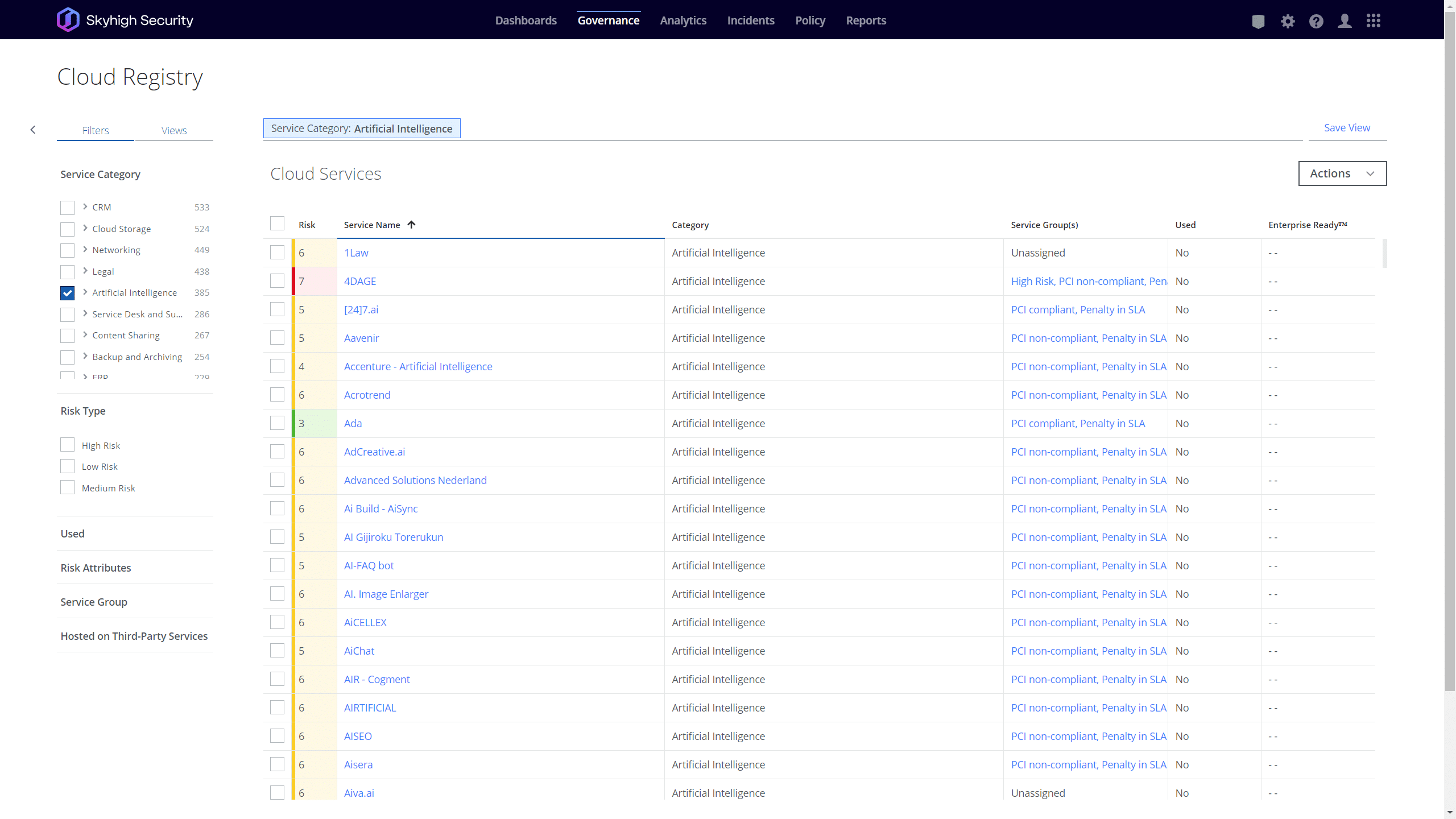

Bloqueo por categoría/aplicación

Muchas organizaciones no sienten apetito por los riesgos que plantean los chatbots de IA y otros servicios de IA generativa. Para estas entidades, bloquear rotundamente el uso de estas aplicaciones es su estrategia preferida. Apple se ha unido recientemente a una lista cada vez mayor de estas empresas. Pero, como llevo años diciendo a nuestros clientes de Secure Web Gateway (SWG), "Bloquear algo es fácil. Cualquiera puede hacerlo. Saber qué bloquear es lo difícil". Dicho esto, cualquier SWG que se precie hoy en día ya debería conocer estas herramientas de IA y debería poder crear fácilmente una política para bloquearlas. En el momento de escribir estas líneas, el registro en la nube deSkyhigh Security contiene un análisis de riesgos completo de más de 400 aplicaciones de IA, ¡y la lista crece día a día! Cada una de ellas incluye más de 65 atributos de riesgo y una lista de todos los dominios relacionados con las aplicaciones. Con sólo un par de clics, estos ricos datos pueden aprovecharse en las políticas de seguridad web de nuestros clientes para controlar estas apps. Para los clientes que buscan prohibir el uso de chatbots de IA, este es el "botón fácil" para ellos.

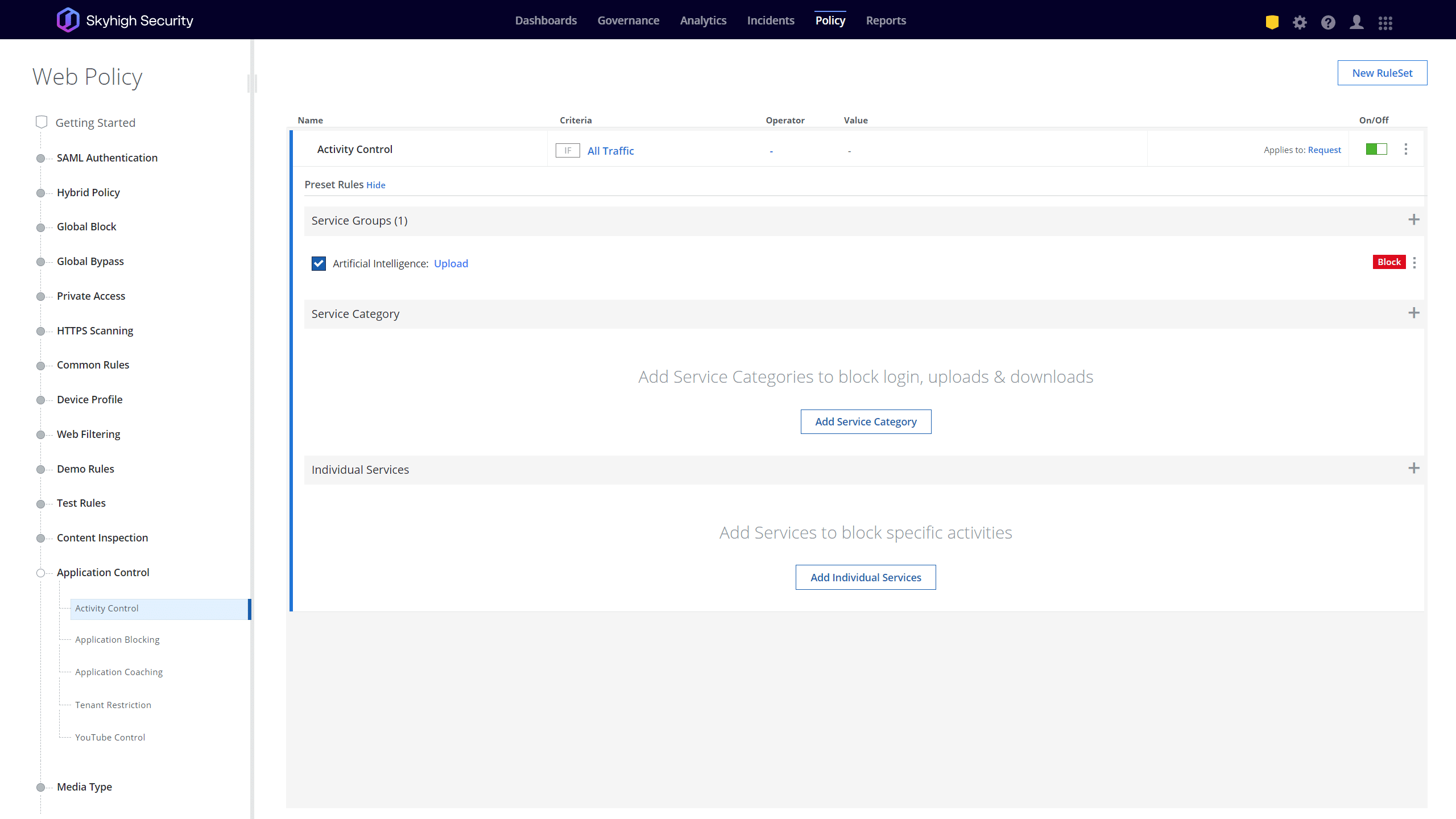

Restricción de actividades específicas

Algunas organizaciones ven el valor de permitir el uso de chatbots de IA, pero quieren asegurarse de que sus datos más críticos permanezcan seguros. Hoy en día existen varias formas de despellejar a este proverbial gato. Una opción es utilizar el control de actividad para permitir una aplicación basada en IA pero impedir ciertas actividades como la carga de archivos o el envío de avisos. El SWG de Skyhigh admite controles de actividad para las más de 35.000 aplicaciones de nuestro registro, incluidas las más de 400 categorizadas como IA. De nuevo, con sólo unos clics podrá impedir la carga de cualquier contenido a estas aplicaciones en cuestión de minutos.

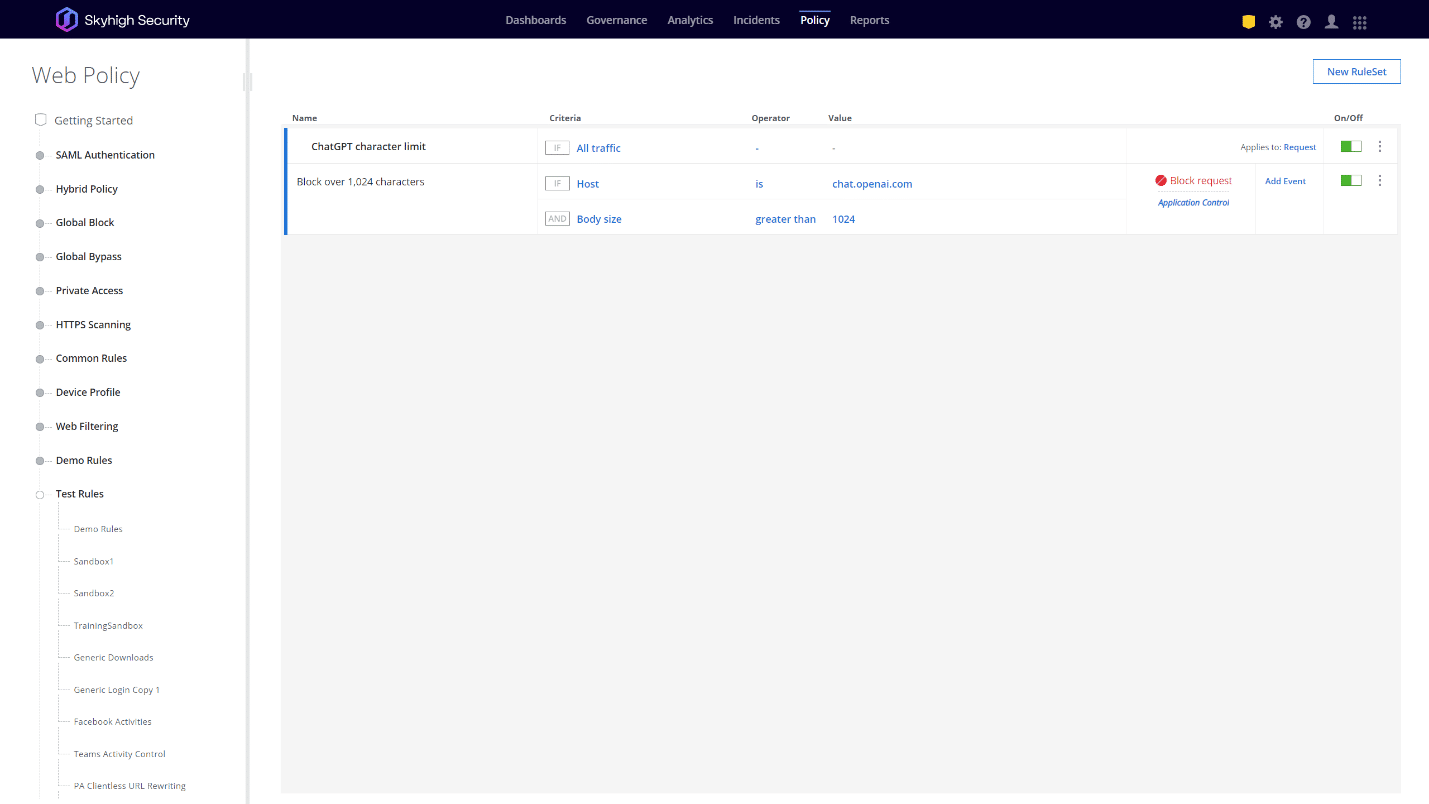

Por supuesto, algunas aplicaciones, como ChatGPT, pueden quedar inutilizadas al impedir actividades como el envío de preguntas. ¿De qué sirve permitir la aplicación si no se le pueden hacer preguntas? En estas situaciones, es posible que los clientes quieran adoptar un enfoque más matizado. Samsung, por ejemplo, respondió inicialmente a sus filtraciones de datos limitando las preguntas de ChatGPT a 1.024 bytes. Otras opciones pueden incluir impedir la carga de determinados tipos de archivos, limitar el acceso en función de la geolocalización, etc. Para muchas de estas opciones, se requiere un motor de políticas Web altamente granular. La solución SWG de Skyhigh cuenta, sin duda, con el motor de políticas Web más potente y granular del mercado actual, lo que agiliza el trabajo en casos de uso como éstos. Por ejemplo, con una única regla personalizada nuestros clientes pueden implementar una política que, si una solicitud a cualquier plataforma basada en IA supera los 1024 bytes, la bloquee. Así pues, sea cual sea su enfoque preferido, es probable que le permitamos ejercer ese control con facilidad.

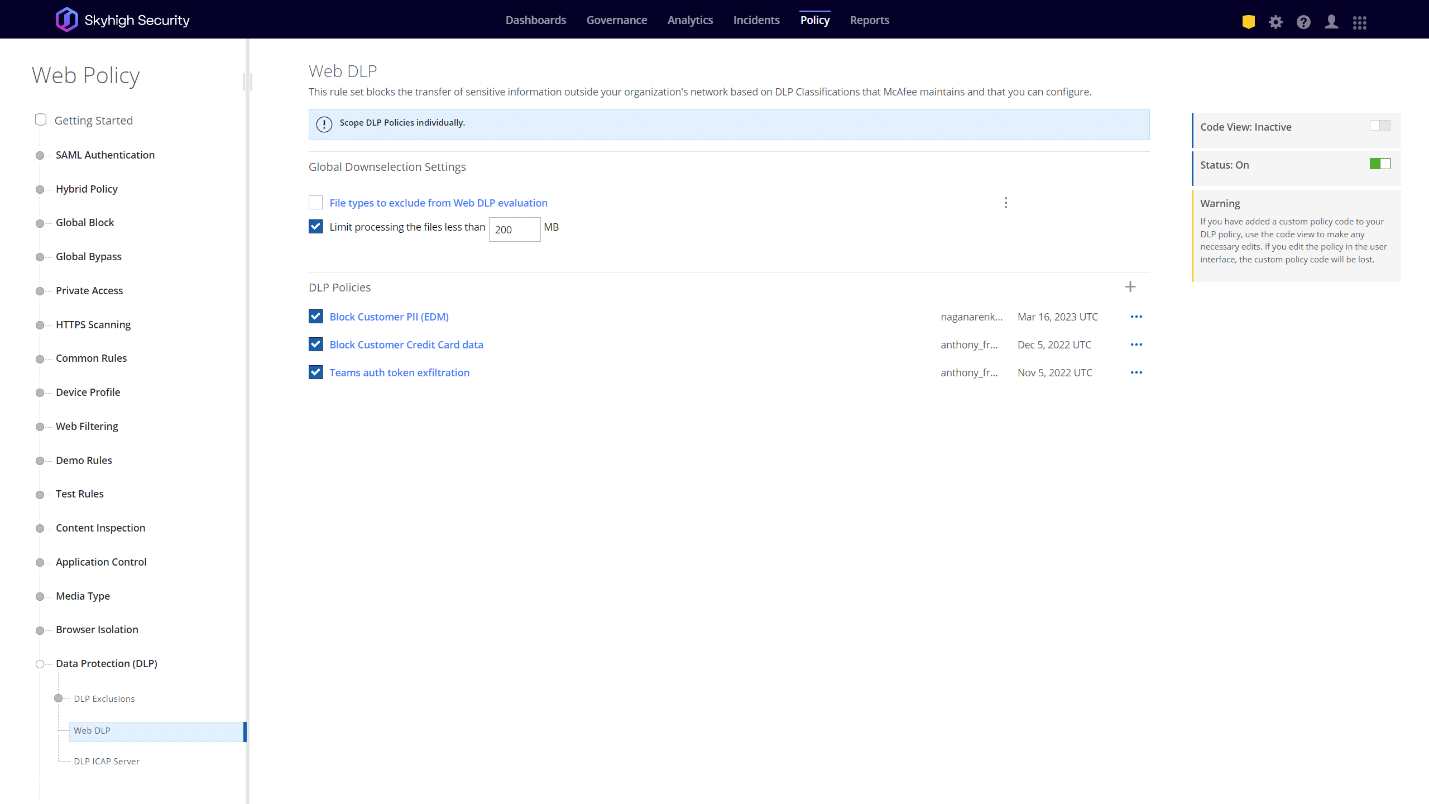

Proteger los datos críticos de su empresa

Personalmente, creo que el mejor enfoque pasa por el conocimiento de los datos. En el mundo actual basado en la nube, las organizaciones ya deberían tener un buen control de los datos que necesitan proteger, y deberían aplicar una política para evitar que esos datos se envíen a cualquier aplicación externa que no esté autorizada y debidamente protegida por la organización. En este sentido, ChatGPT no es realmente diferente de una cuenta personal de Dropbox. Su organización puede permitir y tolerar el uso de Dropbox personal, pero también debería asegurarse de que sus datos más críticos no se suben a esta aplicación no sancionada y no segura. Del mismo modo, las organizaciones con programas de seguridad de datos maduros probablemente ya tendrán una política para evitar que los datos sensibles sean exfiltrados a cualquier aplicación no sancionada, lo que naturalmente debería extenderse a aplicaciones como ChatGPT. Los clientes de Skyhigh Security ya están por delante de la curva en esta área, ya que ya están aprovechando un motor Data Loss Prevention (DLP) maduro y muy avanzado con capacidades robustas como Exact Data Match (EDM), Indexed Data Matching (IDM), Optical Character Recognition (OCR), y más.

Un avance reciente de OpenAI que aporta esperanzas adicionales es un nuevo control para desactivar los historiales de conversaciones de ChatGPT y el entrenamiento en esas conversaciones. Con sólo pulsar un interruptor en la interfaz de usuario, los usuarios pueden indicar que no desean que se almacenen sus datos y que no se utilicen para el entrenamiento de ChatGPT. Los usuarios tendrán que activar manualmente esta opción, que está desactivada por defecto, pero ofrece una capa adicional de seguridad para evitar que el modelo ChatGPT se entrene en datos potencialmente sensibles. Skyhigh Security ya ha probado una política en nuestra solución SWG que obliga a activar esta nueva opción para cualquier dispositivo gestionado que pase por nuestro proxy, independientemente de la cuenta en la que esté conectado el usuario.

Sancionar el servicio

OpenAI también ha anunciado planes para una suscripción ChatGPT Business en el futuro. Con esta nueva opción de suscripción, las organizaciones podrán crear cuentas empresariales para sus usuarios y gestionar de forma centralizada el tratamiento de sus datos. Esto podría, potencialmente, poner en juego varias otras capacidades de la plataforma Skyhigh Security SSE. La primera es lo que llamamos "restricciones de inquilino", que le permite permitir el inicio de sesión sólo a su inquilino autorizado, o instancia, de una aplicación, al tiempo que bloquea las cuentas personales y de terceros. Esto será fundamental si las organizaciones quieren seguir el camino de ChatGPT Business para aplicar políticas de tratamiento de datos en toda la empresa. Hacerlo sería inútil si no pudiera impedir también que los usuarios inicien sesión en cuentas ChatGPT personales no controladas.

Skyhigh SecurityEl equipo de ingeniería de OpenAI ya ha realizado con éxito una prueba de concepto interactuando con las API de OpenAI para escudriñar los archivos subidos a la plataforma de OpenAI utilizando la parte cloud access security broker (CASB) de nuestra cartera. Aunque las API de OpenAI aún no son compatibles con todos los casos de uso, seguiremos buscando oportunidades para escanear y remediar datos sensibles en inquilinos empresariales en un proceso fuera de banda utilizando nuestras capacidades de API CASB.

Del mismo modo, si ChatGPT ofrece la posibilidad de utilizar el inicio de sesión único (SSO) de un proveedor de identidades externo, la tecnología CASB de Skyhigh Securitypodrá aportar valor. Al conectarse al proceso de traspaso SAML entre ChatGPT y un proveedor de identidad de terceros, el CASB puede ponerse en línea para cualquier dispositivo del mundo que se autentique en su inquilino ChatGPT y realizar el control de acceso al dispositivo. De este modo, podríamos restringir el acceso a ChatGPT de su organización para que sólo accedan los dispositivos de confianza. No se ha confirmado, en el momento de escribir estas líneas, que OpenAI tenga previsto ofrecer SSO, pero es muy probable, ya que se trata de un enfoque habitual para la autenticación y la gestión de cuentas.

A mis colegas de Skyhigh Security, lo que acabamos de comentar les sonará como un breve resumen de nuestras conversaciones diarias con los clientes. Esto es lo que hacemos. Puede que los chatbots de IA, y en concreto ChatGPT, aporten un nuevo giro al riesgo de pérdida de datos, pero para los profesionales de la seguridad de datos sigue siendo el mismo trabajo que requiere las mismas herramientas y con lo mismo en juego. Lo más probable es que ya esté preparado con muchas de estas herramientas, pero si encuentra que sus controles de seguridad son deficientes, denos la oportunidad de mostrarle cómo podemos ayudarle. Esto nos va como anillo al dedo, porque proteger los datos de nuestros clientes es lo que hacemos todos los días.

Para saber más sobre cómo Skyhigh Security puede ayudarle póngase en contacto con nosotros hoy mismo.

Volver a BlogsContenido relacionado

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Blogs de moda

Skyhigh Security Renews IRAP Assessment at PROTECTED Level for 2026

Sarang Warudkar and Stuart Bayliss May 21, 2026

The Browser Security Gap Enterprises Can No Longer Ignore

Sarang Warudkar May 19, 2026

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Ste Nadin May 14, 2026

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Sarang Warudkar and Stuart Bayliss April 30, 2026

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Ste Nadin April 23, 2026