Ressourcen

Führen Sie ChatGPT ein, ohne Ihre geschäftskritischen Daten aufs Spiel zu setzen

Von Tony Frum - Produktspezialist, Skyhigh Security

Juni 6, 2023 6 Minute gelesen

Da ich mit einem Telefon mit Drehscheibe aufgewachsen bin, habe ich im Laufe meiner Jahre eine ganze Menge an technologischem Fortschritt erlebt. Ich denke jedoch, dass er im Vergleich zu dem, was meine Kinder zu Lebzeiten durch das Aufkommen der Künstlichen Intelligenz (KI) erleben werden, verblassen wird. Experten auf diesem Gebiet verwenden übertriebene Vergleiche wie die Atombombe und die Entdeckung des Feuers, um die Bedeutung der KI zu beschreiben, und es besteht eine gute Chance, dass dies keine Übertreibungen sind.

Diese Entwicklung sorgt für große Bestürzung. Einige fordern Sicherheitsmaßnahmen, staatliche Regulierungen und sogar ein Moratorium für die KI-Forschung. Im Bereich der Cybersicherheit ist man sehr besorgt über den Einsatz von KI-Tools wie ChatGPT und deren Auswirkungen auf die Datensicherheit. Als ein wahnsinnig datenfokussierter Security Service Edge (SSE) Anbieter werden wir bei Skyhigh Security mindestens einmal täglich gefragt, wie Datenverluste durch ChatGPT verhindert werden können. Unsere Kunden lesen von Vorfällen wie dem Datenverlust bei Samsung über ChatGPT und wollen sicherstellen, dass sie die richtigen Kontrollen eingerichtet haben.

Trotz der Neuartigkeit von Tools wie ChatGPT muss ich dem Drang widerstehen, Prediger zu zitieren: "Es gibt nichts Neues unter der Sonne." Das Risiko, dass ein KI-Modell auf Ihren Daten trainiert wird, mag zwar neu sein, aber die Logistik zum Schutz Ihrer Daten vor ChatGPT ist eigentlich nichts Neues. Das ist es, was wir jeden Tag tun! Und um es ganz offen zu sagen: Wenn Sie über die richtigen Datensicherheitskontrollen verfügen, dann sollten Sie bereits alles im Griff haben. Schauen wir uns kurz die anwendbaren Kontrollen an, von denen Sie wahrscheinlich schon viele im Einsatz haben, und wie sie Ihnen helfen können, dieses neue, aber nicht ganz so neue Risiko zu bewältigen.

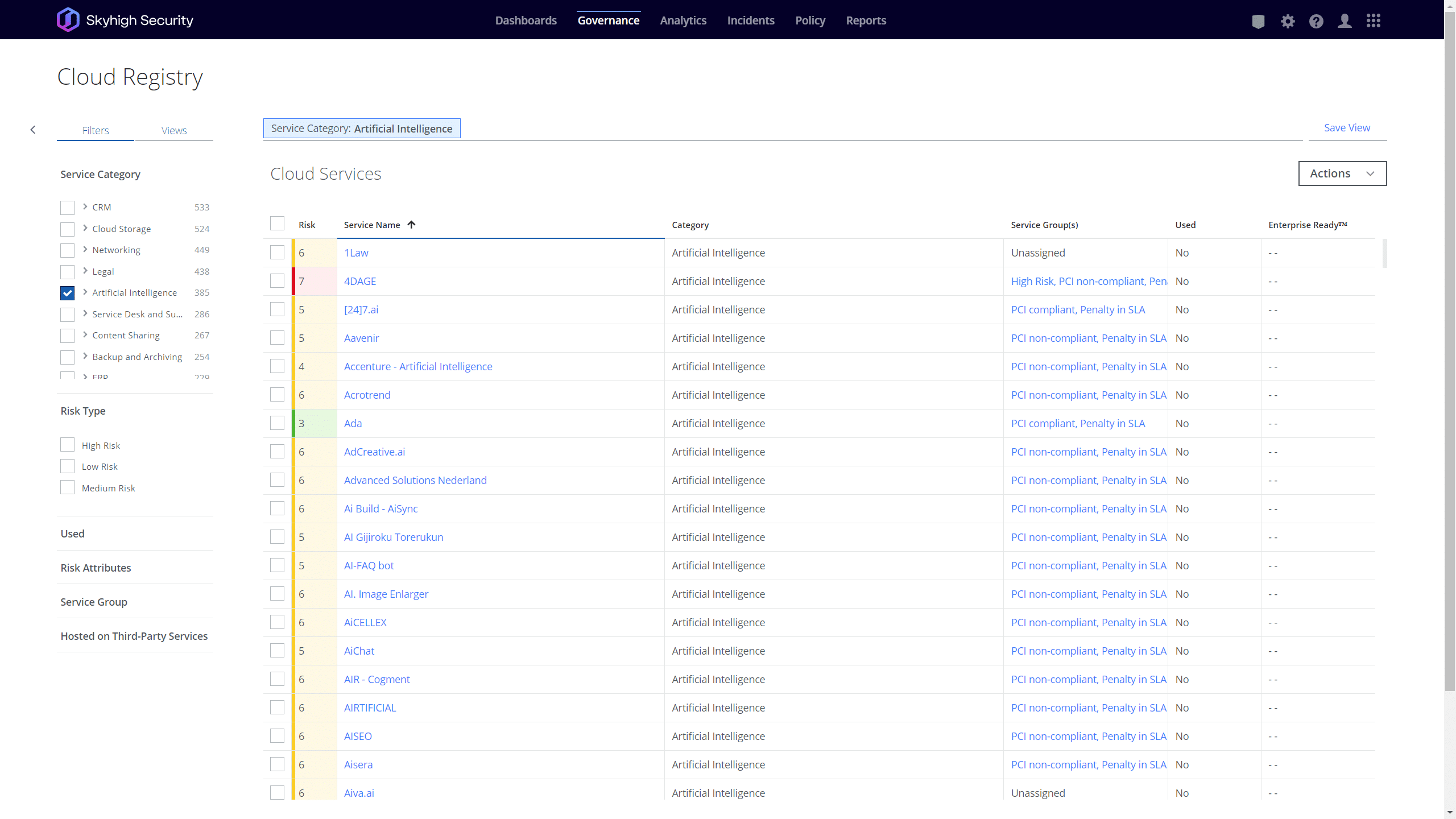

Sperrung nach Kategorie/App

Viele Unternehmen haben keinen Appetit auf die Risiken, die von KI-Chatbots und anderen generativen KI-Diensten ausgehen. Für diese Unternehmen ist es die bevorzugte Strategie, die Nutzung dieser Apps ganz zu unterbinden. Apple hat sich kürzlich einer wachsenden Liste dieser Unternehmen angeschlossen. Aber, wie ich unseren Kunden von Secure Web Gateway (SWG) schon seit Jahren sage: "Etwas zu blockieren ist einfach. Jeder kann das tun. Zu wissen, was zu blockieren ist, ist der schwierige Teil." Davon abgesehen sollte jede SWG, die etwas auf sich hält, diese KI-Tools bereits kennen und in der Lage sein, problemlos eine Richtlinie zu erstellen, um sie zu blockieren. Zum Zeitpunkt der Erstellung dieses Artikels enthält das Cloud-Register vonSkyhigh Security eine vollständige Risikoanalyse von über 400 KI-Anwendungen, und die Liste wird täglich länger! Jede dieser Anwendungen enthält über 65 Risikoattribute und eine Liste aller Domains, die mit den Anwendungen in Verbindung stehen. Mit nur wenigen Klicks können diese umfangreichen Daten in den Web-Sicherheitsrichtlinien unserer Kunden genutzt werden, um diese Anwendungen zu kontrollieren. Für Kunden, die die Verwendung von KI-Chatbots verbieten möchten, ist dies der "einfache Knopf".

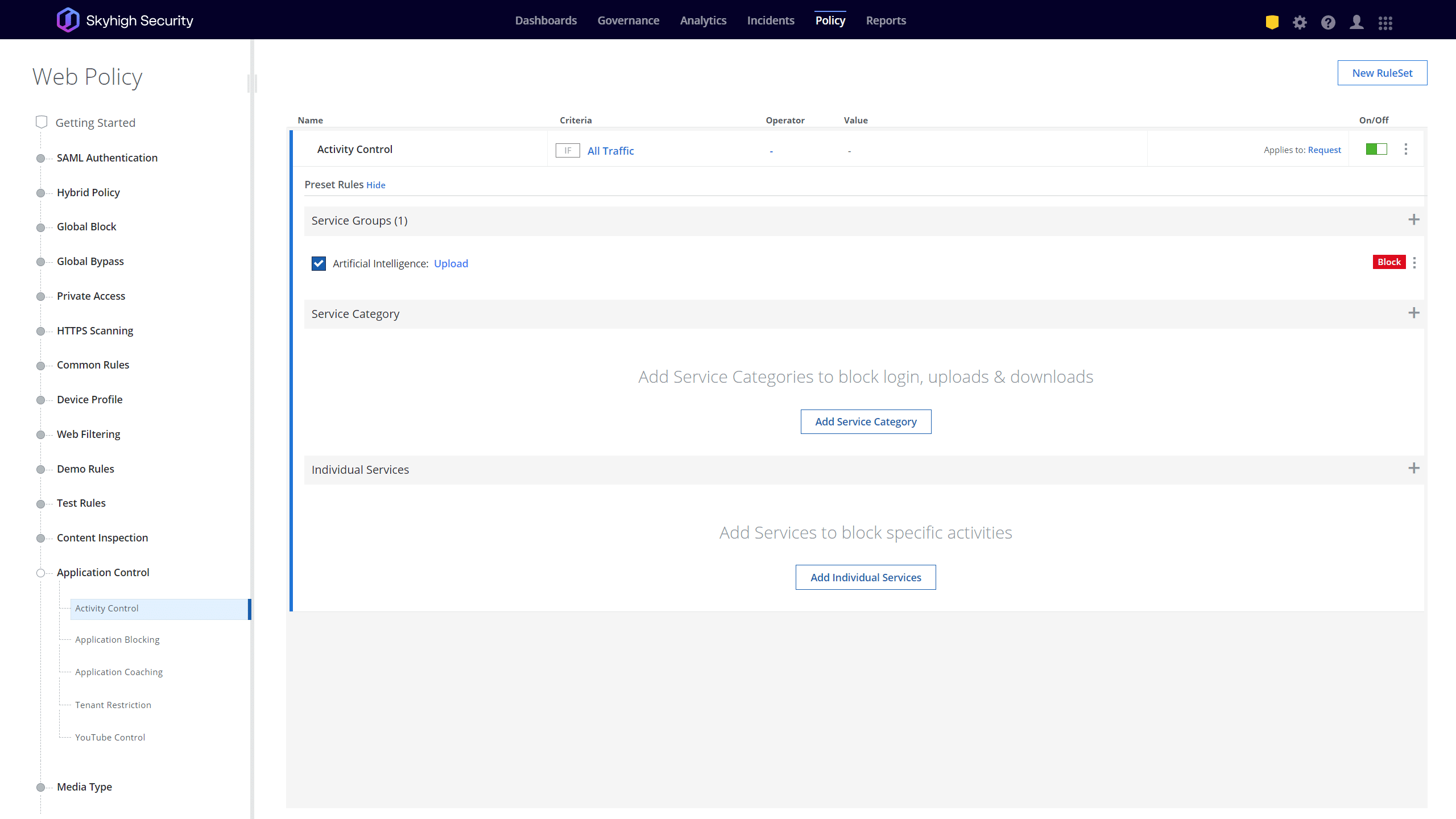

Bestimmte Aktivitäten einschränken

Einige Unternehmen sehen einen Nutzen darin, den Einsatz von KI-Chatbots zuzulassen, möchten aber sicherstellen, dass ihre kritischen Daten sicher bleiben. Es gibt heute mehrere Möglichkeiten, diese sprichwörtliche Katze zu häuten. Eine Möglichkeit ist die Verwendung der Aktivitätskontrolle, um eine KI-basierte Anwendung zuzulassen, aber bestimmte Aktivitäten wie das Hochladen von Dateien oder das Senden von Aufforderungen zu verhindern. Die SWG von Skyhigh unterstützt die Aktivitätskontrolle für alle über 35.000 Anwendungen in unserer Registrierung, einschließlich der über 400 Anwendungen, die als KI kategorisiert sind. Auch hier können Sie mit nur wenigen Klicks in wenigen Minuten das Hochladen von Inhalten in diese Anwendungen verhindern.

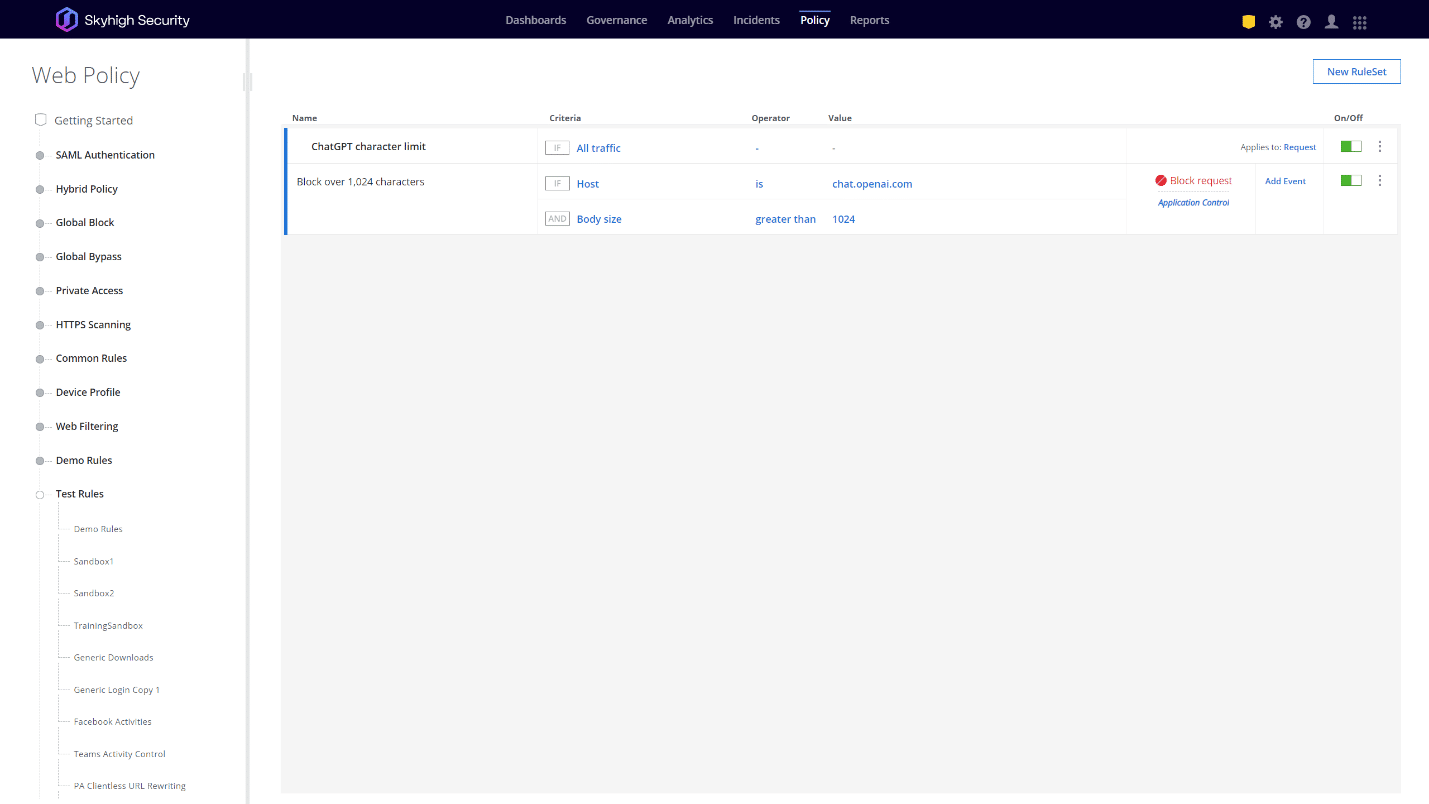

Natürlich können einige Anwendungen wie ChatGPT unbrauchbar gemacht werden, indem Aktivitäten wie das Senden von Fragen verhindert werden. Was nützt es, die App zuzulassen, wenn man ihr keine Fragen stellen kann? In solchen Situationen sollten Kunden vielleicht einen differenzierteren Ansatz wählen. Samsung zum Beispiel hat zunächst auf die Datenlecks reagiert, indem es die ChatGPT-Aufforderungen auf 1.024 Bytes begrenzt hat. Weitere Optionen sind das Verhindern des Hochladens bestimmter Dateitypen, die Beschränkung des Zugriffs auf der Grundlage des Standorts und vieles mehr. Für viele dieser Optionen ist eine hochgradig granulare Web Policy Engine erforderlich. Die Skyhigh SWG-Lösung verfügt zweifellos über die leistungsstärkste und granularste Webrichtlinien-Engine, die derzeit auf dem Markt erhältlich ist und solche Anwendungsfälle schnell erledigt. Mit einer einzigen benutzerdefinierten Regel können unsere Kunden zum Beispiel eine Richtlinie implementieren, die eine Anfrage an eine KI-basierte Plattform blockiert, wenn sie 1024 Bytes überschreitet. Welchen Ansatz Sie auch immer bevorzugen, mit uns können Sie diese Kontrolle mühelos ausüben.

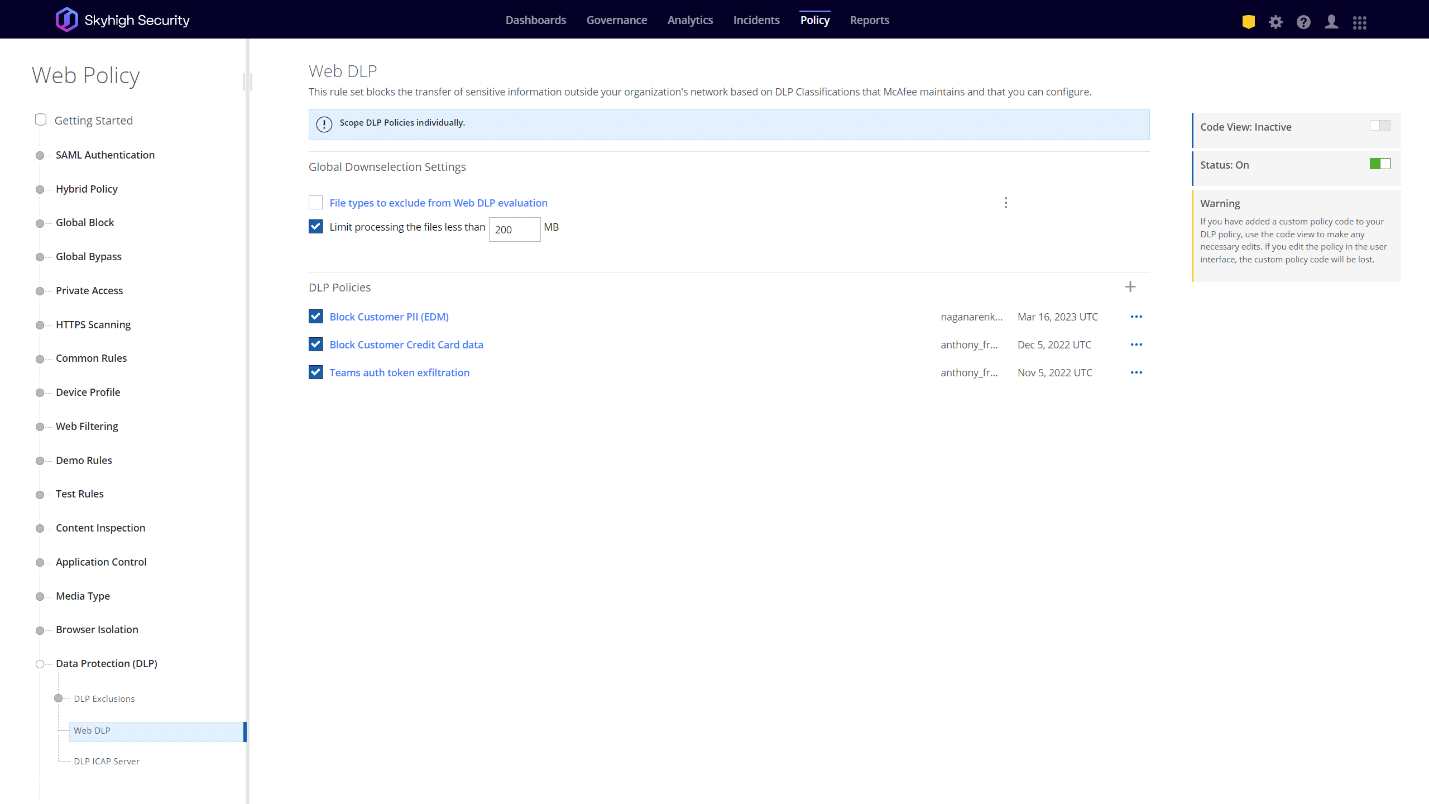

Schutz Ihrer geschäftskritischen Daten

Ich persönlich bin der Meinung, dass der beste Ansatz das Bewusstsein für Daten ist. In der heutigen Cloud-basierten Welt sollten Unternehmen bereits genau wissen, welche Daten sie schützen müssen, und sie sollten eine Richtlinie anwenden, um zu verhindern, dass diese Daten an eine externe Anwendung gesendet werden, die nicht von der Organisation genehmigt und ordnungsgemäß gesichert ist. In dieser Hinsicht unterscheidet sich ChatGPT nicht wirklich von einem persönlichen Dropbox-Konto. Ihr Unternehmen mag die Nutzung von Dropbox erlauben und tolerieren, aber es sollte auch sicherstellen, dass seine wichtigsten Daten nicht in diese nicht genehmigte und ungesicherte Anwendung hochgeladen werden. Ebenso verfügen Unternehmen mit ausgereiften Datensicherheitsprogrammen wahrscheinlich bereits über eine Richtlinie, die verhindert, dass sensible Daten in nicht genehmigte Anwendungen hochgeladen werden, was natürlich auch für Anwendungen wie ChatGPT gelten sollte. Skyhigh Security Kunden sind in diesem Bereich bereits einen Schritt voraus, da sie bereits eine ausgereifte und hochentwickelte Data Loss Prevention (DLP) Engine mit robusten Funktionen wie Exact Data Match (EDM), Indexed Data Matching (IDM), Optical Character Recognition (OCR) und mehr nutzen.

Eine aktuelle Entwicklung von OpenAI, die zusätzliche Hoffnung macht, ist ein neues Steuerelement zur Deaktivierung der ChatGPT-Gesprächsverläufe und des Trainings auf diesen Gesprächen. Durch einfaches Umlegen eines Schalters in der Benutzeroberfläche können Benutzer angeben, dass sie nicht möchten, dass ihre Daten gespeichert werden und dass sie nicht für das Training von ChatGPT verwendet werden sollen. Die Benutzer müssen diese Option, die standardmäßig deaktiviert ist, manuell aktivieren, aber sie bietet eine zusätzliche Sicherheitsebene, um zu verhindern, dass das ChatGPT-Modell mit potenziell sensiblen Daten trainiert wird. Skyhigh Security hat bereits eine Richtlinie in unserer SWG-Lösung getestet, die erzwingt, dass diese neue Option für jedes verwaltete Gerät, das über unseren Proxy läuft, aktiviert wird, unabhängig davon, bei welchem Konto der Benutzer angemeldet ist.

Sanktionierung des Dienstes

OpenAI hat außerdem Pläne für ein ChatGPT Business-Abonnement in der Zukunft angekündigt. Mit dieser neuen Abonnementoption können Unternehmen Geschäftskonten für ihre Nutzer einrichten und den Umgang mit ihren Daten zentral verwalten. Dies könnte möglicherweise mehrere andere Funktionen der Skyhigh Security SSE-Plattform ins Spiel bringen. Die erste ist das, was wir "Mandanteneinschränkungen" nennen. Damit können Sie Anmeldungen nur für den von Ihnen genehmigten Mandanten oder die Instanz einer Anwendung zulassen und persönliche Konten und Konten von Dritten sperren. Dies ist von entscheidender Bedeutung, wenn Unternehmen den Weg über ChatGPT Business gehen möchten, um Richtlinien für den Umgang mit Daten unternehmensweit anzuwenden. Dies wäre sinnlos, wenn Sie nicht auch verhindern könnten, dass sich Benutzer bei unkontrollierten, persönlichen ChatGPT-Konten anmelden.

Skyhigh SecurityDas Engineering-Team von OpenAI hat bereits erfolgreich einen Proof of Concept durchgeführt, bei dem es mit den APIs von OpenAI interagiert hat, um Dateien, die auf die OpenAI-Plattform hochgeladen wurden, unter Verwendung des cloud access security broker (CASB) -Teils unseres Portfolios zu überprüfen. Obwohl die OpenAI-APIs noch nicht alle Anwendungsfälle unterstützen, werden wir auch weiterhin nach Möglichkeiten suchen, sensible Daten in Unternehmensmietern in einem Out-of-Band-Prozess mit Hilfe unserer CASB-API-Funktionen zu scannen und zu bereinigen.

Wenn ChatGPT die Möglichkeit bietet, Single Sign-On (SSO) von einem Identitätsanbieter eines Drittanbieters zu nutzen, kann die CASB-Technologie von Skyhigh Securityebenfalls einen Mehrwert bieten. Durch die Einbindung in den SAML-Übergabeprozess zwischen ChatGPT und einem Identitätsanbieter eines Drittanbieters kann sich der CASB bei jedem Gerät auf der Welt, das sich bei Ihrem ChatGPT-Mandanten authentifiziert, einklinken und eine Zugriffskontrolle für das Gerät durchführen. Auf diese Weise wären wir in der Lage, den Zugang zu ChatGPT in Ihrem Unternehmen zu beschränken, so dass nur vertrauenswürdige Geräte Zugang erhalten. Zum Zeitpunkt der Erstellung dieses Artikels wurde noch nicht bestätigt, dass OpenAI plant, SSO anzubieten, aber es ist sehr wahrscheinlich, da dies ein gängiger Ansatz für die Authentifizierung und Kontoverwaltung ist.

Für meine Kollegen bei Skyhigh Security wird das, was wir gerade besprochen haben, wie eine kurze Zusammenfassung unserer täglichen Gespräche mit Kunden klingen. Das ist es , was wir tun. KI-Chatbots und insbesondere ChatGPT mögen dem Risiko von Datenverlusten eine neue Wendung geben, aber für Datensicherheitsexperten ist es immer noch derselbe Job, der dieselben Tools erfordert und bei dem dasselbe auf dem Spiel steht. Die Chancen stehen gut, dass Sie mit vielen dieser Tools bereits vorbereitet sind. Wenn Sie jedoch feststellen, dass Ihre Sicherheitskontrollen unzureichend sind, geben Sie uns die Chance, Ihnen zu zeigen, wie wir Ihnen helfen können. Das ist genau unser Metier, denn der Schutz der Daten unserer Kunden ist unser tägliches Geschäft.

Um mehr darüber zu erfahren, wie Skyhigh Security Ihnen helfen kann, kontaktieren Sie uns noch heute.

Zurück zu BlogsVerwandter Inhalt

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Laufende Blogs

Skyhigh Security Renews IRAP Assessment at PROTECTED Level for 2026

Sarang Warudkar and Stuart Bayliss May 21, 2026

The Browser Security Gap Enterprises Can No Longer Ignore

Sarang Warudkar May 19, 2026

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Ste Nadin May 14, 2026

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Sarang Warudkar and Stuart Bayliss April 30, 2026

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Nick LeBrun April 23, 2026