Sumber daya

Keamanan AI: Kebutuhan dan Peluang Pelanggan

Oleh Sekhar Sarukkai - Cybersecurity@UC Berkeley

28 September 2024 6 Menit Baca

Semua tanda di industri ini menunjukkan pertumbuhan yang merajalela dalam inovasi dan adopsi alat dan layanan AI. Investasi di perusahaan rintisan kecerdasan buatan (AI) melonjak hingga $24 miliar dari April hingga Juni, lebih dari dua kali lipat dari kuartal sebelumnya, menurut data dari Crunchbase. 75% pendiri dalam kelompok Y Combinator terbaru sedang mengerjakan startup AI dan hampir semua vendor teknologi melakukan pembenahan strategi mereka untuk menjadi berpusat pada AI.

Dalam sebuah survei baru-baru ini, PWC menemukan bahwa lebih dari 50% perusahaan telah mengadopsi genAI dan 73% perusahaan di Amerika Serikat telah mengadopsi AI setidaknya di beberapa area fungsi bisnis mereka. Baru bulan ini, OpenAI juga mengumumkan kursi perusahaannya yang ke-1 juta - kurang dari satu tahun sejak mereka merilis produk enterprise.

Dengan semua investasi dan inovasi ini, ada sisi negatif dari bahaya AI, dan perspektif tentang masalah keamanan, keselamatan, privasi, dan tata kelola terbesar yang akan membuat perusahaan tidak menggunakan AI dalam produksi. Blog ini, yang pertama dari seri ini, menangkap perspektif saya tentang tantangan keamanan utama yang dihadapi oleh tumpukan AI yang telah saya kumpulkan selama setahun terakhir.

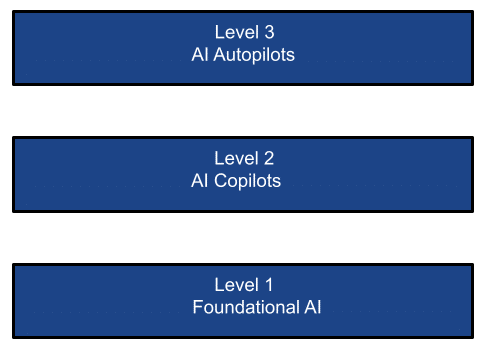

Tumpukan AI yang disederhanakan

Perkembangan teknologi AI dapat dilihat dalam tiga lapisan berikut ini:

LAYER 1: Kecerdasan Buatan (AI) Dasar

Model fondasi adalah bentuk kecerdasan buatan generatif. Model ini menghasilkan output dari perintah berbasis bahasa manusia. Model didasarkan pada jaringan saraf yang kompleks termasuk jaringan permusuhan generatif, transformer, dan penyandi variasional. Laju inovasi dalam AI dasar sangat menakjubkan dengan rilis yang mengubah permainan, yang terbaru adalah GPT-4o dengan model multimodalnya. Uang besar telah memompa uang besar pada tingkat ini, pada dasarnya memilih pemenang di lapisan infrastruktur AI inti ini.

Ada dua jenis infrastruktur dalam lapisan ini:

- Model-model yayasan didominasi oleh orang-orang seperti OpenAI, Google Gemini, Mistral, Grok, Llama, dan Anthropic. Model-model ini (sumber terbuka atau sumber tertutup) dilatih pada korpus data yang sangat besar (publik atau pribadi). Model-model tersebut dapat digunakan untuk inferensi sebagai SaaS (seperti ChatGPT), PaaS (seperti AWS Bedrock, platform Azure/Google AI) atau digunakan dalam instance pribadi. Perusahaan-perusahaan model fondasi ini sendiri menyumbang hampir 50% dari bisnis chip AI Nvidia.

- Model khusus yang jumlahnya ribuan dapat ditemukan di pasar seperti Hugging Face. Model-model ini dilatih pada kumpulan data khusus (publik atau pribadi) untuk kasus penggunaan yang ditargetkan atau vertikal. Model-model ini juga bisa digunakan sebagai layanan SaaS atau PaaS, atau dengan menerapkannya dalam instance pribadi. Selain itu, perusahaan dapat memilih untuk membuat dan menggunakan model mereka sendiri yang disesuaikan dengan baik yang digunakan di pusat data pribadi, Cloud pribadi, atau di lingkungan Hibrida (mis. H2O.ai). Laporan triwulanan terbaru dari Microsoft, misalnya, menunjukkan bahwa meskipun pertumbuhan cloud publik secara umum tanpa mempertimbangkan AI PaaS hanya sedikit, bagian yang paling cepat berkembang dari bisnis cloud publik adalah AI PaaS.

Kasus Penggunaan LLM/SLM:

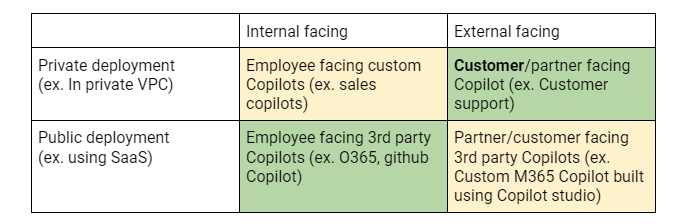

Ringkasan kasus penggunaan pelanggan di setiap lapisan dapat dilihat dari perspektif dua dimensi: Sumbu X yang mengidentifikasi apakah upaya/aplikasi AI ditargetkan untuk karyawan internal atau pelanggan/mitra eksternal. Sumbu Y mengidentifikasi apakah penerapan aplikasi AI berada di instance pribadi (katakanlah di Google/MS AI atau AWS Bedrock) atau jika itu adalah Layanan SaaS pihak ketiga (seperti ChatGPT). Matriks ini membantu memperjelas risiko keamanan, pergerakan pembeli/pengadopsi, dan persyaratan utama.

Matriks 2×2 di atas menunjukkan berbagai kasus penggunaan yang mendorong adopsi LLM di perusahaan dan prioritas penerapan pelanggan. Sel hijau menunjukkan investasi/POC saat ini. Sel kuning menunjukkan perkembangan aktif, dan sel merah menunjukkan potensi investasi di masa depan.

Lapisan 2: Pilot Bersama AI

Jika mindshare adalah ukuran keberhasilan di lapisan dasar AI, pendapatan tidak diragukan lagi merupakan tolok ukur di lapisan ini. Sama seperti saat booming internet, vendor infrastruktur internet (seperti AT&T) sangat penting tetapi bukan penerima manfaat bisnis terbesar dari revolusi internet. Aplikasi-aplikasi yang menggunakan infrastruktur internet ini untuk menciptakan aplikasi baru dan menarik seperti Google, Uber, dan Meta adalah pemenang yang lebih besar. Demikian pula, di era AI, aplikasi bernilai besar sudah muncul dalam bentuk co-pilot AI: seperti yang dinyatakan oleh Satya Nadela, CEO Microsoft di Ignite 2023 bahwa mereka adalah perusahaan co-pilot, yang membayangkan masa depan di mana semua hal dan semua orang akan memiliki co-pilot. Penelitian telah menunjukkan potensi peningkatan 30+% dalam produktivitas pengembang, atau peningkatan 50+% dalam produktivitas pemrosesan klaim asuransi. Tidak heran jika Nadela baru-baru ini menyatakan bahwa Copilot adalah produk suite M365 Microsoft yang paling cepat berkembang. Produk ini telah menjadi pemimpin dalam penerapan co-pilot perusahaan. Data terbaru Skyhigh menegaskan hal ini dengan peningkatan penggunaan M365 Copilot sebesar 5000+% dalam 6 bulan terakhir!

Lebih penting lagi, ini adalah teknologi genAI yang dominan digunakan di perusahaan-perusahaan besar meskipun penetrasi M365 Copilot hanya sebesar 1% dari bisnis M365 - menyisakan ruang yang sangat besar untuk pertumbuhan. Dampaknya terhadap perusahaan tidak boleh diremehkan - jumlah data perusahaan yang diindeks, serta data yang dibagikan dengan M365 Copilot belum pernah terjadi sebelumnya. Hampir semua perusahaan memblokir ChatGPT dan hampir semuanya juga mengizinkan O365 Co-pilot yang pada gilirannya menggunakan layanan Azure AI (terutama OpenAI). Harga tambahan M365 per kursi untuk Copilot akan menjadi model bagi semua vendor SaaS untuk meluncurkan co-pilot mereka sendiri, menghasilkan aliran pendapatan yang menguntungkan.

Kasus Penggunaan Co-pilot:

Matriks 2×2 di atas menunjukkan berbagai kasus penggunaan yang mendorong adopsi Copilots di perusahaan dan prioritas penerapan pelanggan. Sel hijau menunjukkan investasi/POC saat ini. Sel kuning menunjukkan perkembangan aktif, dan sel merah menunjukkan potensi investasi di masa depan.

Lapisan 3: Pilot Otomatis AI

Dan kemudian ada lapisan pilot otomatis AI - sistem agen yang melakukan tugas dengan sedikit atau tanpa campur tangan manusia. Ini menjanjikan untuk menjadi lapisan yang akan mendobrak bisnis SI/konsultasi yang sekarang masih manual, mahal, dan menurut beberapa perkiraan hampir 8-10 kali lipat dari bisnis SaaS/perangkat lunak. Pada tahap awal, sistem agentic (sistem yang dirancang untuk bertindak sebagai agen otonom) ini menjanjikan keunggulan dalam analisis tugas, pemecahan tugas, dan eksekusi tugas secara otonom sebagai respons terhadap tujuan yang ditetapkan [atau tersirat] oleh pengguna. Hal ini berpotensi menghilangkan peran manusia dalam prosesnya. Ada banyak pendanaan VC yang saat ini menargetkan bidang ini. Sebanyak 75% dari 75% startup dalam kelompok YC baru-baru ini adalah startup AI yang berada di lapisan ini. Baru minggu lalu, Salesforce mengumumkan Agentforce mereka untuk meningkatkan produktivitas karyawan dan Microsoft memperkenalkan Agen Copilot yang awalnya ditargetkan untuk UKM yang dapat memungkinkan otomatisasi proses bisnis, serta perluasan Copilot Studio mereka untuk mendukung Agen khusus.

Ada agen otonom untuk asisten pribadi (mis. Multion.ai), agen pendukung (mis. Ada.cx, intercom.com), pengembang (mis. Cognition.ai (devin), Cursor.com, Replit.com), tim penjualan (mis. Apollo.io, accountstory.com), operasi keamanan (mis. AirMDR.com, Prophetsecurity.ai, AgamottoSecurity.com, torq.io), peneliti UX (mis. Altis.io, Maze.co), perancang UX (mis. DesignPro.ai), Integrator Sistem (mis. TechStack.management), manajer proyek (mis. Clickup.com), karyawan back office keuangan (mis. Prajna.ai), atau bahkan karyawan AI universal (mis. ema.co). Beberapa penelitian menunjukkan bahwa sistem agen yang mengotomatiskan tindakan tersebut dapat menghasilkan 1,5 triliun dolar AS dari pengeluaran perangkat lunak tambahan, memposisikan perusahaan-perusahaan jenis baru ini menjadi pelopor perusahaan layanan-sebagai-perangkat lunak berikutnya yang dapat mendominasi lanskap TI.

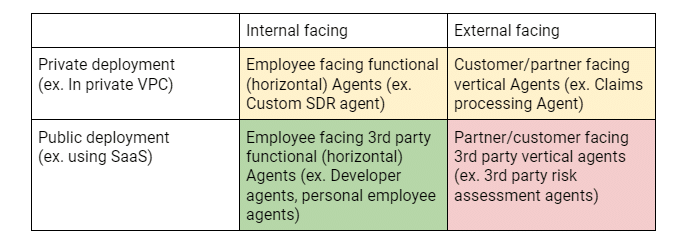

Kasus Penggunaan Pilot Otomatis:

Matriks 2×2 di atas menunjukkan berbagai kasus penggunaan yang mendorong adopsi Agen di perusahaan dan prioritas penerapan pelanggan. Sel hijau menunjukkan investasi/POC saat ini. Sel kuning menunjukkan perkembangan aktif, dan sel merah menunjukkan potensi investasi di masa depan.

Kebutuhan dan Peluang Keamanan AI

Tidak mengherankan, sejak peluncuran ChatGPT hanya 2 tahun yang lalu, istilah-istilah keamanan, privasi, dan tata kelola yang sebelumnya tidak dikenal telah menjadi arus utama seperti: rekayasa cepat, jailbreak, halusinasi, keracunan data, dan lain-lain. Industri ini dengan cepat memahami isu-isu baru ini dan telah menghasilkan beberapa metrik yang digunakan untuk mengukur kecenderungan berbagai LLM untuk menunjukkan karakteristik ini. Open Worldwide Application Security Project (OWASP) telah melakukan pekerjaan yang baik dalam mengidentifikasi 10 risiko LLM teratas yang komprehensif dan diperbarui secara aktif. Selain itu, Enkrypt AI telah melakukan pekerjaan yang baik dalam menciptakan dan memelihara papan peringkat keamanan LLM yang komprehensif yang merupakan alat yang berguna untuk membandingkan skor keamanan LLM terkemuka di empat dimensi yaitu bias, toksisitas, jailbreak, dan malware. Analisis yang sama juga dapat dilakukan untuk LLM khusus melalui red-teaming mereka.

Namun, mengingat konteks penuh dari tumpukan AI, mengambil pandangan sempit tentang keamanan AI adalah hal yang naif. Setiap lapisan membutuhkan masalah yang berbeda untuk dipertimbangkan untuk mengatasi tantangan unik yang dibebankan oleh pembeli yang berpotensi berbeda. Misalnya, tim ulang untuk mengidentifikasi masalah dengan model yang digunakan oleh pelanggan kemungkinan besar akan menarik bagi tim aplikasi, sedangkan kebocoran data melalui pilot bersama atau data yang digunakan untuk menyempurnakan model dapat menjadi masalah keamanan informasi atau CDO.

Dalam beberapa blog berikutnya, saya akan membahas lebih dalam tentang risiko keamanan dan solusi yang diusulkan di masing-masing dari tiga lapisan yang dijelaskan.

Blog Lain Dalam Seri Ini:

- Bagian 1 - Keamanan AI: Kebutuhan dan Peluang Pelanggan

- Bagian 2 - AI Dasar: Lapisan Kritis dengan Tantangan Keamanan

- Bagian 3 - Risiko dan Tantangan Keamanan dengan Kopilot AI

Konten Terkait

Blog yang sedang tren

Skyhigh Security Renews IRAP Assessment at PROTECTED Level for 2026

Sarang Warudkar and Stuart Bayliss May 21, 2026

The Browser Security Gap Enterprises Can No Longer Ignore

Sarang Warudkar May 19, 2026

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Ste Nadin May 14, 2026

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Sarang Warudkar and Stuart Bayliss April 30, 2026

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Nick LeBrun April 23, 2026