موارد

أمن الذكاء الاصطناعي: احتياجات العملاء والفرص المتاحة

بقلم سيخار ساروكاي - الأمن السيبراني في جامعة بيركلي

سبتمبر 28, 2024 سبتمبر 2024 6 قراءة دقيقة

تشير جميع الدلائل في هذا المجال إلى النمو الهائل في الابتكار واعتماد أدوات وخدمات الذكاء الاصطناعي. ارتفعت الاستثمارات في الشركات الناشئة في مجال الذكاء الاصطناعي إلى 24 مليار دولار في الفترة من أبريل إلى يونيو، أي أكثر من الضعف مقارنة بالربع السابق، وفقًا لبيانات من Crunchbase. يعمل 75% من المؤسسين في مجموعة Y Combinator الأخيرة على شركات ناشئة تعمل في مجال الذكاء الاصطناعي، ويعمل جميع بائعي التكنولوجيا تقريبًا على تجديد استراتيجيتهم لتتمحور حول الذكاء الاصطناعي.

في استطلاع حديث، وجدت شركة PWC أن أكثر من 50% من الشركات قد اعتمدت بالفعل الذكاء الاصطناعي الجيني، وأن 73% من الشركات الأمريكية قد اعتمدت بالفعل الذكاء الاصطناعي في بعض مجالات وظائفها التجارية على الأقل. في هذا الشهر فقط، أعلنت OpenAI أيضًا عن حصولها على المقعد رقم مليون للمؤسسات - في أقل من عام منذ إطلاقها لمنتج المؤسسات.

مع كل هذا الاستثمار والابتكار يأتي الجانب السلبي لمخاطر الذكاء الاصطناعي، ووجهات النظر حول أكبر مخاوف الأمن والسلامة والخصوصية والحوكمة التي ستمنع الشركات من استخدام الذكاء الاصطناعي في الإنتاج. هذه المدونة، وهي الأولى في سلسلة، تجسد وجهة نظري حول التحديات الأمنية الرئيسية التي تواجه حزمة الذكاء الاصطناعي التي جمعتها على مدار العام الماضي.

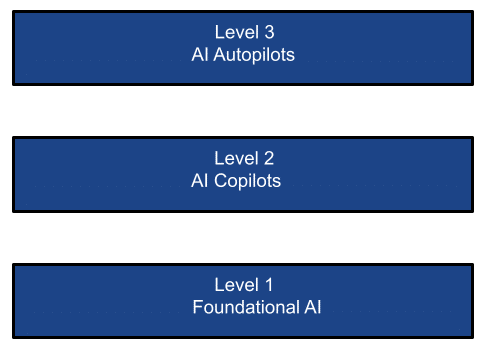

مكدس الذكاء الاصطناعي المبسط

يمكن النظر إلى انتشار تقنيات الذكاء الاصطناعي في الطبقات الثلاث التالية:

الطبقة 1: الذكاء الاصطناعي التأسيسي

النماذج التأسيسية هي شكل من أشكال الذكاء الاصطناعي التوليدي. وهي تولد مخرجات من مطالبات تعتمد على اللغة البشرية. تعتمد النماذج على الشبكات العصبية المعقدة بما في ذلك الشبكات التوليدية الخصامية والتحويلية والترميزات المتغيرة. لقد كانت وتيرة الابتكار في مجال الذكاء الاصطناعي التأسيسي مذهلة مع الإصدارات التي غيّرت قواعد اللعبة، وآخرها مع GPT-4o بنموذجها متعدد الوسائط. لقد ضخت الأموال الطائلة أموالاً طائلة على هذا المستوى، وهو ما يعني في جوهره اختيار الفائزين في هذه الطبقة الأساسية للبنية التحتية للذكاء الاصطناعي.

هناك نوعان من البنية التحتية في هذه الطبقة:

- النماذج التأسيسية التي تهيمن عليها أمثال OpenAI وGoogle Gemini وMistral وGrok وLlama وAnthropic. يتم تدريب هذه النماذج (مفتوحة المصدر أو قريبة المصدر) على مجموعة ضخمة من البيانات (العامة أو الخاصة). ويمكن استخدام النماذج للاستدلال كخدمة SaaS (مثل ChatGPT) أو PaaS (مثل AWS Bedrock أو Azure/Google AI platforms) أو نشرها في حالات خاصة. تستحوذ شركات نماذج الأساس هذه وحدها على ما يقرب من 50% من أعمال رقاقات الذكاء الاصطناعي الخاصة بشركة Nvidia.

- نماذج مخصصة يمكن العثور على الآلاف منها في سوق مثل Hugging Face. يتم تدريب هذه النماذج على مجموعات بيانات متخصصة (عامة أو خاصة) لحالات الاستخدام أو القطاعات المستهدفة. يمكن أيضًا استهلاكها كخدمات SaaS أو PaaS، أو عن طريق نشرها في حالات خاصة. بالإضافة إلى ذلك، يمكن للمؤسسات أن تختار إنشاء ونشر نماذجها المضبوطة بدقة والمنشورة في مراكز البيانات الخاصة بها أو السحابة الخاصة أو في البيئات الهجينة (مثل H2O.ai). تُظهر التقارير الفصلية الأخيرة من Microsoft، على سبيل المثال، أنه على الرغم من أن نمو السحابة العامة العامة دون النظر إلى الذكاء الاصطناعي كخدمة هو نمو متواضع فقط، فإن الجزء الأسرع نموًا في أعمال السحابة العامة هو الذكاء الاصطناعي كخدمة.

حالات استخدام LLM/SLM:

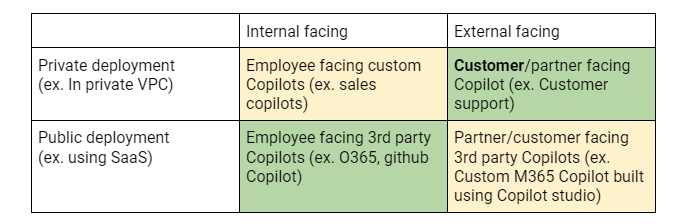

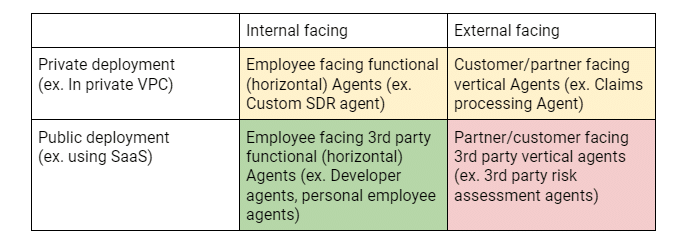

يمكن الاطلاع على ملخص لحالات استخدام العملاء في كل طبقة من منظور بُعدين: المحور X الذي يحدد ما إذا كان جهد/تطبيق الذكاء الاصطناعي يستهدف الموظفين الداخليين أو العملاء/الشركاء الخارجيين. ويحدد المحور Y ما إذا كان نشر تطبيق الذكاء الاصطناعي في مثيل خاص (على سبيل المثال على Google/MS AI أو AWS Bedrock) أو إذا كان تطبيقاً تابعاً لجهة خارجية كخدمة SaaS (مثل ChatGPT). تساعد هذه المصفوفة في توضيح المخاطر الأمنية، وحركة المشتري/المتبنّي، والمتطلبات الرئيسية.

تُظهر مصفوفة 2×2 أعلاه حالات الاستخدام المختلفة التي تدفع إلى اعتماد الآلات ذات المسؤولية المحدودة في المؤسسات وأولويات نشر العملاء. تشير الخلايا الخضراء إلى الاستثمارات/عمليات التشغيل الحالية. تشير الخلايا الصفراء إلى التطورات النشطة، وتشير الخلايا الحمراء إلى الاستثمارات المستقبلية المحتملة.

الطبقة 2: مساعدو الطيارين بالذكاء الاصطناعي

إذا كانت الحصة الذهنية هي مقياس النجاح في طبقة الذكاء الاصطناعي التأسيسية، فلا شك أن الإيرادات هي المقياس في هذه الطبقة. تمامًا كما حدث في طفرة الإنترنت، كان بائعو البنية التحتية للإنترنت (فكر في شركة AT&Ts) مهمين ولكن لم يكونوا أكبر المستفيدين من ثورة الإنترنت. كانت التطبيقات التي استخدمت هذه البنية التحتية للإنترنت لإنشاء تطبيقات جديدة ومثيرة للاهتمام مثل Google و Uber و Meta هي التي كانت الرابح الأكبر. وعلى نحو مماثل، في عصر الذكاء الاصطناعي، بدأت التطبيقات الكبيرة التي تبلغ قيمتها بالدولار في الظهور بالفعل في شكل طيارين مساعدين للذكاء الاصطناعي: كما أعلن ساتيا نادلا الرئيس التنفيذي لشركة مايكروسوفت في مؤتمر Ignite 2023 أنهم شركة طيارين مساعدين، متصورين مستقبلاً حيث سيكون لكل شيء وكل شخص طيار مساعد. وقد أظهرت الدراسات إمكانية تحقيق مكاسب تزيد عن 30٪ في إنتاجية المطورين، أو أكثر من 50٪ في إنتاجية معالجة مطالبات التأمين بالفعل. لا عجب أن ناديلا صرحت مؤخرًا أن Copilot هو أسرع منتجات مجموعة M365 من مايكروسوفت نموًا. لقد أصبح بالفعل رائداً في عمليات النشر التجريبية المشتركة للمؤسسات. تؤكد بيانات Skyhigh الأخيرة هذا الأمر مع زيادة استخدام M365 Copilot بنسبة تزيد عن 5000% في الأشهر الستة الماضية!

والأهم من ذلك أنها تقنية الذكاء الاصطناعي الجيني المهيمنة المستخدمة في الشركات الكبيرة على الرغم من أن نسبة انتشار M365 Copilot لا تتجاوز 1% من أعمال M365 - مما يترك مجالاً كبيراً للنمو. لا ينبغي الاستهانة بالتأثير على الشركات - فكمية البيانات المؤسسية التي تتم فهرستها، وكذلك البيانات التي تتم مشاركتها مع M365 Copilot غير مسبوقة. تحظر جميع المؤسسات تقريبًا ChatGPT وتسمح جميعها تقريبًا أيضًا بخدمة O365 Co-pilot التي تستخدم بدورها خدمة Azure AI (بشكل أساسي OpenAI). يتشكّل تسعير M365 الإضافي لكل مقعد لـ Copilot ليكون نموذجاً لجميع بائعي SaaS لطرح برامجهم التجريبية المشتركة الخاصة بهم، مما يولد تدفقاً مربحاً للإيرادات.

حالات استخدام الطيار المساعد:

تُظهر مصفوفة 2×2 أعلاه حالات الاستخدام المختلفة التي تدفع إلى اعتماد Copilots في المؤسسات وأولويات نشر العملاء. تشير الخلايا الخضراء إلى الاستثمارات/عمليات التشغيل الحالية. تشير الخلايا الصفراء إلى التطورات النشطة، وتشير الخلايا الحمراء إلى الاستثمارات المستقبلية المحتملة.

الطبقة 3: الطيار الآلي للذكاء الاصطناعي

ثم هناك طبقة الروبوتات الآلية للذكاء الاصطناعي - وهي أنظمة وكيلة تؤدي المهام دون تدخل بشري يذكر. وتعد هذه الطبقة بأن تكون الطبقة التي ستفتح المجال أمام أعمال الاستشارات/الاستشارات التي هي الآن يدوية ومكلفة وتبلغ حسب بعض التقديرات ما يقرب من 8-10 أضعاف حجم أعمال البرمجيات/ البرمجيات كخدمة. وعلى الرغم من أن هذه الأنظمة الوكيلة (الأنظمة المصممة للعمل كوكلاء مستقلين) لا تزال في بداياتها، إلا أنها تعد بالتفوق في تحليل المهام، وتفصيل المهام، وتنفيذ المهام بشكل مستقل استجابةً للأهداف التي يحددها [أو يوحي بها] المستخدمون. ومن المحتمل أن يؤدي ذلك إلى الاستغناء عن الإنسان في الحلقة. هناك الكثير من تمويل رأس المال الجريء الذي يستهدف هذا المجال حاليًا. فالكثير من 75% من الشركات الناشئة في مجموعة شركات YC الأخيرة هي شركات ناشئة في مجال الذكاء الاصطناعي تندرج في هذه الطبقة. في الأسبوع الماضي، أعلنت شركة Salesforce الأسبوع الماضي فقط عن وكيلها Agentforce لتعزيز إنتاجية الموظفين، وقدمت شركة Microsoft وكلاء Copilot Agents التي تستهدف في البداية الشركات الصغيرة والمتوسطة والتي يمكن أن تتيح أتمتة العمليات التجارية، بالإضافة إلى توسيع نطاق Copilot Studio لدعم الوكلاء المخصصين.

There are autonomous agents for a personal assistant (ex. Multion.ai), support agents (ex. Ada.cx, intercom.com), developers (ex. Cognition.ai (devin), Cursor.com, Replit.com), sales team (ex. Apollo.io, accountstory.com), security operations (ex. AirMDR.com, Prophetsecurity.ai، AgamottoSecurity.com، torq.io)، باحث في تجربة المستخدم (مثل Altis.io، Maze.co)، مصمم تجربة المستخدم (مثل DesignPro.ai)، مُدمج الأنظمة (مثل TechStack.management)، مدير مشروع (مثل Clickup.com)، موظفو المكتب الخلفي المالي (مثل Prajna.ai)، أو حتى موظف ذكاء اصطناعي عالمي (مثل ema.co). تشير بعض الدراسات إلى أن مثل هذه الأنظمة الوكيلة التي تعمل على أتمتة الإجراءات يمكن أن تؤدي إلى إنفاق إضافي على البرمجيات بقيمة 1.5 تريليون دولار، مما يجعل هذه السلالة الجديدة من الشركات في الطليعة التالية من شركات الخدمات كبرمجيات التي يمكن أن تهيمن على مشهد تكنولوجيا المعلومات.

حالات استخدام الطيار الآلي:

تُظهر مصفوفة 2×2 أعلاه حالات الاستخدام المختلفة التي تقود اعتماد الوكلاء في المؤسسات وأولويات نشر العملاء. تشير الخلايا الخضراء إلى الاستثمارات/عمليات التشغيل الحالية. تشير الخلايا الصفراء إلى التطورات النشطة، وتشير الخلايا الحمراء إلى الاستثمارات المستقبلية المحتملة.

الاحتياجات والفرص الأمنية للذكاء الاصطناعي

ليس من المستغرب أنه منذ الكشف عن ChatGPT منذ عامين فقط، أصبحت مصطلحات جديدة لم تكن معروفة حتى الآن في مجال الأمن والخصوصية والحوكمة سائدة مثل: الهندسة السريعة، وكسر الحماية، والهلوسة، وتسميم البيانات، وما إلى ذلك. وقد سارعت الصناعة إلى الالتفاف حول هذه القضايا الجديدة ونتج عن ذلك بعض المقاييس المستخدمة لقياس ميل مختلف تطبيقات LLM لإظهار هذه الخصائص. وقد قام مشروع أمن التطبيقات العالمي المفتوح (OWASP) بعمل جيد في تحديد أهم 10 مخاطر في إدارة البرمجيات الخفيفة ذات المسؤولية المحدودة والتي يتم تحديثها بشكل شامل وفعال. بالإضافة إلى ذلك، قامت شركة Enkrypt AI بعمل جيد في إنشاء وصيانة لوحة صدارة شاملة لسلامة LLM، وهي أداة مفيدة لقياس درجات الأمان لأبرز برامج LLM الرائدة عبر أربعة أبعاد هي التحيز والسمية واختراق الحماية والبرمجيات الخبيثة. يمكن أيضًا إجراء التحليل نفسه لـ LLMs المخصصة عبر الفريق الأحمر.

ومع ذلك، وبالنظر إلى السياق الكامل لحزمة الذكاء الاصطناعي، فإن إلقاء نظرة ضيقة على أمن الذكاء الاصطناعي أمر ساذج. تتطلب كل طبقة قضايا متميزة يجب النظر فيها من أجل معالجة التحديات الفريدة التي يفرضها المشترون المختلفون المحتملون. على سبيل المثال، من المرجح أن تكون عملية التشاور الأحمر لتحديد المشكلات المتعلقة بالنماذج التي يتم نشرها من قبل العملاء موضع اهتمام فريق التطبيق، في حين أن تسرب البيانات عبر الطيارين المشاركين أو البيانات المستخدمة لضبط النماذج قد يكون مصدر قلق لأمن المعلومات أو مديري أمن المعلومات.

في المدونات القليلة القادمة، سأتعمق أكثر في المخاطر الأمنية والحلول المقترحة في كل طبقة من الطبقات الثلاث الموصوفة.

مدونات أخرى في هذه السلسلة

- الجزء 1 - أمن الذكاء الاصطناعي: احتياجات العملاء والفرص المتاحة

- الجزء 2 - الذكاء الاصطناعي التأسيسي: طبقة حرجة ذات تحديات أمنية

- الجزء 3 - المخاطر والتحديات الأمنية مع الذكاء الاصطناعي المساعد

مضامين ذات صلة

المدونات الرائجة

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Sarang Warudkar and Stuart Bayliss April 30, 2026

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Nick LeBrun April 23, 2026

Skyhigh Security Achieves BSI C5 Certification, Bringing the Full SSE Portfolio to the German Market

Stuart Bayliss and Sarang Warudkar April 16, 2026

"ديجا فو" في إدارة الخدمات الرقمية (DSPM): لماذا نعيد بناء الدرع الورقي لتكنولوجيا المعلومات غير الرسمية

توني فروم 19 مارس 2026