موارد

إنتليجنس دايجست

تسريب بيانات روبوت الدردشة الآلية المزعوم: روبوت الدردشة الآلي المزعوم

تقارير عن تسريب بيانات من روبوت دردشة آلي شهير مدعوم بالذكاء الاصطناعي يهدد

بقلم رودمان رامزانيان - مستشار أمان السحابة للمؤسسات

فبراير 24, 2025 فبراير 2025 7 دقائق للقراءة

لقد اندمجت روبوتات الدردشة المدعومة بالذكاء الاصطناعي بسلاسة في كل جانب من جوانب حياتنا تقريباً، بدءاً من الإجابة عن الأسئلة والمساعدة في خدمة العملاء إلى إدارة المهام الشخصية وإجراء المعاملات. وبفضل قدرتها على توفير تفاعلات فورية وشخصية، فإننا نشارك البيانات الحساسة بحرية، وغالباً دون تفكير. ومع ذلك، عندما تتعرض خدمة روبوتات الدردشة الآلية لتسريب البيانات، فإن ذلك لا يعرض الخصوصية الفردية للخطر فحسب، بل يضرب الثقة التي وضعها المستخدمون في هذه التقنيات. إن الحجم الهائل من البيانات الشخصية والمالية وبيانات المحادثة المتبادلة مع أنظمة الذكاء الاصطناعي هذه يعني أن أي خرق قد يكون له عواقب بعيدة المدى، مما يؤثر على كل شيء بدءاً من الأمن الشخصي إلى موثوقية خدمات الذكاء الاصطناعي التي نعتمد عليها.

أفادت تقارير أن أحد القراصنة ادعى أنه اخترق OmniGPT، وهي منصة دردشة وإنتاجية للذكاء الاصطناعي واسعة الاستخدام، وذلك وفقًا للمعلومات المنشورة على منتديات الاختراق سيئة السمعة. ويُزعم أن الاختراق كشف عن البيانات الشخصية لـ 30,000 مستخدم، بما في ذلك رسائل البريد الإلكتروني وأرقام الهواتف وأكثر من 34 مليون سطر من سجلات المحادثات. وبالإضافة إلى محادثات المستخدمين، تتضمن البيانات المكشوفة أيضاً روابط لملفات تم تحميلها، وبعضها يحتوي على معلومات حساسة مثل بيانات الاعتماد وتفاصيل الفوترة ومفاتيح واجهة برمجة التطبيقات.

والحق يُقال؛ من الصعب ألا نشعر بالقلق قليلاً على الأقل من خدمة روبوتات الدردشة الآلية التي تعمل بالذكاء الاصطناعي التي تواجه تسرباً للبيانات، خاصةً بالنظر إلى مدى سرعة ارتفاع شعبية هذه الأدوات. نحن نعتمد عليها في مجموعة من القدرات - من الكتابة الإبداعية والعصف الذهني إلى البحث وحتى أتمتة الأعمال.

لماذا تحدث هذه الحوادث؟

لقد جعلت سهولة الوصول إلى روبوتات الدردشة وخدمات الإبداع المدعومة بالذكاء الاصطناعي وسهولة الوصول إليها جزءاً لا يتجزأ من حياتنا اليومية، ولكن الأمر الأكثر إثارة للقلق هنا هو أن الاختراق حدث في النهاية الخلفية للخدمة. وهذا يعني أنه خارج نطاق أي شيء كان يمكن للمستخدمين أو المستهلكين القيام به لمنع ذلك.

هناك نزعة شائعة للتعامل مع روبوتات الدردشة الآلية القائمة على الذكاء الاصطناعي كمستودع غير رسمي لجميع المعلومات. ولكن في الواقع، تعمل هذه المنصات على أنها "صناديق سوداء"، حيث لا يملك المستخدم أي فكرة عن كيفية التعامل مع بياناته أو تخزينها أو حمايتها. هذا الانفصال بين التصور والواقع يمكن أن يكون له عواقب وخيمة عندما يتم تسريب بيانات حساسة، مثل المستندات التي تم تحميلها ومفاتيح واجهة برمجة التطبيقات والتفاصيل الشخصية، كما رأينا في هذه الحالة.

ولا يقل أهمية عن ذلك التدريب المستمر على التوعية الأمنية للمستخدمين. قد لا يزال العديد من الأشخاص غير مدركين تمامًا للمخاطر المرتبطة بإدخال معلومات حساسة في خدمات روبوتات الدردشة الآلية للذكاء الاصطناعي أو المنصات السحابية. إن تثقيف المستخدمين حول إساءة استخدام البيانات المحتملة والتأكيد على توخي الحذر عند مشاركة البيانات الشخصية أو السرية يمكن أن يقطع شوطاً طويلاً في الحد من التعرض للخطر.

ستستمر جاذبية الخدمات القوية والمجانية في كثير من الأحيان والمعززة بالذكاء الاصطناعي في النمو، مما يجعل النهج التقليدي "ضرب الخلد" في الأمن غير مجدٍ بشكل متزايد. مع ظهور المئات (إن لم يكن الآلاف) من خدمات الذكاء الاصطناعي الجديدة أسبوعياً، فإن فرق الأمن السيبراني غارقة بالفعل ولا يمكنها مواكبة ذلك.

"لقد كان لدينا الكثير من وقت الفراغ في الآونة الأخيرة" - لم يقل أي فريق أمن إلكتروني على الإطلاق!

بدلاً من ملاحقة كل أداة من أدوات الذكاء الاصطناعي، يجب أن يتحول التركيز إلى المخاطر الأساسية. وهذا يعني إعطاء الأولوية لحماية البيانات الحساسة، بغض النظر عن الخدمة التي تتم مشاركتها معها. وسواء كانت منصة ذكاء اصطناعي تبدو مشروعة أو أي مورد آخر من موارد تكنولوجيا المعلومات في الظل، فإن الحد من تفاعلات البيانات وتنفيذ تدابير أمنية قوية سيثبت أنه أكثر فعالية بكثير من محاولة مراقبة مشهد متزايد من أدوات الذكاء الاصطناعي. وكما توضح الأحداث الأخيرة، يمكن حتى للخدمات التي تبدو قوية المظهر أن تصبح أهدافاً لجهات التهديد المتطورة.

ما الذي يمكن عمله؟

لا يمكن إنكار أن الذكاء الاصطناعي ثوري بلا شك، حيث يعمل على تغيير الصناعات والحياة اليومية بطرق لا حصر لها. ومع ذلك، فمن وجهة نظر تقنية بحتة، فإن خدمات الذكاء الاصطناعي، لا سيما تلك التي يتم الوصول إليها عبر الويب والسحابة، هي في الأساس مجرد مواقع إلكترونية أو منصات سحابية. وفي حين أن تقنياتها الأساسية قوية ومبتكرة بشكل ملحوظ، إلا أنها من منظور الأمن السيبراني تمثل وسيلة محتملة أخرى لتسريب البيانات والوصول غير المصرح به. بالنسبة للمتخصصين في مجال الأمن المكلفين بحماية البيانات المؤسسية الحساسة مثل سجلات المواطنين ومعلومات تحديد الهوية الشخصية ورمز المصدر، يجب النظر إلى خدمات الذكاء الاصطناعي من خلال عدسة تكنولوجيا المعلومات الخفية.

وبينما يقود الذكاء الاصطناعي الكفاءة والابتكار، فإنه يفرض أيضًا تحديات مثل انتهاكات البيانات، وانتهاكات الامتثال، واستخدام الذكاء الاصطناعي الخفي. وغالبًا ما يتجاوز الاعتماد السريع للذكاء الاصطناعي الحوكمة، مما يجعل المؤسسات عرضة لمخاطر السمعة والمخاطر المالية والقانونية دون اتخاذ تدابير أمنية مناسبة.

تشمل تكنولوجيا معلومات الظل، بحكم تعريفها، أي خدمة غير مصرح بها أو مصرح بها صراحةً لاستخدام الشركات ومعاملات البيانات. عند النظر إلى خدمات الذكاء الاصطناعي على أنها تكنولوجيا معلومات الظل، تصبح المخاطر المرتبطة بها واضحة. هل تسمح بإدخال بيانات العملاء الحساسة إلى موقع إلكتروني غير معتمد؟ هل ستسمح بتحميل مرفقات سرية إلى خدمة سحابية غير معروفة؟ هل ستسمح للموظفين باستخدام منصات مستضافة في ولايات قضائية ذات ممارسات مشكوك فيها لحماية البيانات؟ يجب أن تكون الإجابة على كل هذه الأسئلة بالنفي القاطع.

إن التعامل مع خدمات الذكاء الاصطناعي على أنها تكنولوجيا معلومات الظل يفرض تحولاً ضرورياً في المنظور. فبدلاً من الانبهار بقدرات التكنولوجيا، يجب على المؤسسات تطبيق نفس المعايير الأمنية الصارمة التي تطبقها على أي خدمة أخرى غير مصرح بها. ويشمل ذلك تقييد تفاعلات البيانات، والحد من الوصول، وتنفيذ مراقبة قوية لمنع تعرض المعلومات الحساسة للمخاطر الكامنة المرتبطة بأي منصة خارجية غير مُدارة، بغض النظر عن مدى ابتكارها أو فائدتها.

نحن بحاجة ماسة إلى توسيع نطاق قواعد حماية البيانات الحالية لدينا لتشمل تطبيقات الذكاء الاصطناعي، ومن الناحية المثالية، نحن بحاجة إلى مجموعة واحدة من القواعد التي تعمل مع كل شيء - التطبيقات المعتمدة وغير المعتمدة، وحتى تطبيقاتنا الداخلية.

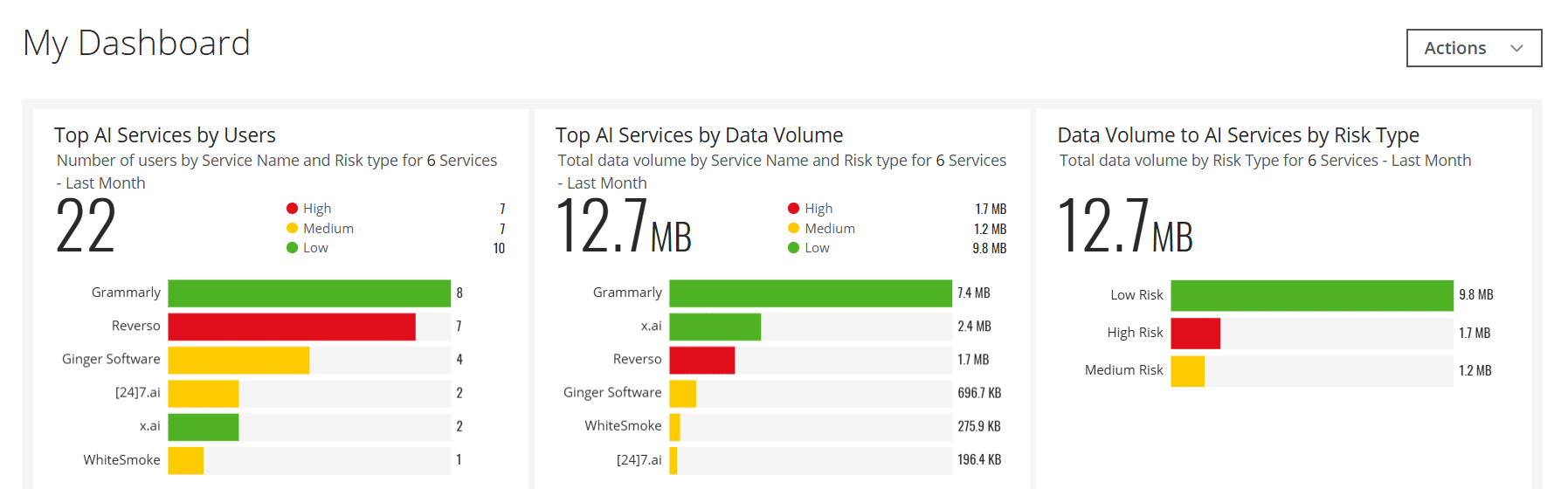

بصفتك ممارسا أمنيا ، بمجرد تحديد المخاطر المرتبطة بخدمة / كيان معين ، فأنت تريد في النهاية طرح ثلاثة أسئلة:

- هل قام أي من مستخدمينا بتصفح / استخدام هذا؟ إذا كان الأمر كذلك ، كم عددهم؟ ومن بالضبط؟

- هل وصل أي جزء من البنية التحتية للويب والسحابة إلى هذه الخدمة؟

- وإذا أدى أي من السؤالين الأولين إلى "نعم" ، فما مقدار البيانات التي تم التعامل معها بين مؤسستك وتلك الخدمة؟

استخدام Skyhigh Security?

- إنشاء بطاقات لوحة معلومات تفاعلية لخدمات الذكاء الاصطناعي لمساعدة فرق الأمان لديك في الحصول على رؤية مهمة وفي الوقت الفعلي

- اكتشاف عمليات نقل بيانات المستخدم إلى خدمات الذكاء الاصطناعي وحظرها مثل ChatGPT والعديد من الخدمات الأخرى باستخدام نُهج مدمجة

- أتمتة خدمات الويب والخدمات السحابية للذكاء الاصطناعي الخطرة ليتم ملؤها في مجموعات خدمات مخصصة استنادًا إلى سمات المخاطر المخصصة، بدلاً من طريقة الفئة الأساسية = الذكاء الاصطناعي

- إدارة خدمات الذكاء الاصطناعي المستخدمة في السيناريوهات الداخلية عبر Secure Web Gateway المخصصة داخل المؤسسة

- الاستفادة من القدرات المدعومة بالذكاء الاصطناعي لمعالجة مجموعة متنوعة من حالات الاستخدام المتعلقة بالكشف عن التهديدات، وإدارة البيانات، والكشف الإيجابي الخاطئ، وغير ذلك الكثير

- تطبيق رؤى أعمق حول مخاطر الذكاء الاصطناعي والمحتوى الذي تم إنشاؤه من خلال التقاط تفاصيل نموذج اللغة الكبيرة (LLM) لفئات الذكاء الاصطناعي

مع أكثر من 11 عاما من الخبرة الواسعة في مجال الأمن السيبراني ، رودمان رامزانيان هو مستشار أمن سحابة المؤسسة ، وهو مسؤول عن الاستشارات الفنية والتمكين وتصميم الحلول والهندسة المعمارية في Skyhigh Security. في هذا الدور ، يركز رودمان بشكل أساسي على الحكومة الفيدرالية الأسترالية والدفاع ومنظمات المؤسسات.

رودمان متخصص في مجالات استخبارات التهديدات العدائية والجرائم الإلكترونية وحماية البيانات والأمن السحابي. وهو مقيم IRAP معتمد من مديرية الإشارات الأسترالية (ASD) - حاصل حاليا على شهادات CISSP و CCSP و CISA و CDPSE و Microsoft Azure و MITRE ATT&CK CTI.

بصراحة ، لدى رودمان شغف قوي بالتعبير عن الأمور المعقدة بعبارات بسيطة ، مما يساعد الشخص العادي والمتخصصين الجدد في مجال الأمن على فهم ماذا ولماذا وكيف للأمن السيبراني.

يسلط الضوء على الهجوم

- يدّعي أحد القراصنة أنه اخترق OmniGPT، وهي خدمة دردشة روبوتية شهيرة تعمل بالذكاء الاصطناعي، وعرض البيانات المسروقة للبيع على الويب المظلم.

- تتضمن البيانات المسروقة أكثر من 30,000 عنوان بريد إلكتروني للمستخدمين وأرقام هواتفهم ومفاتيح واجهة برمجة التطبيقات وغيرها من المعلومات الحساسة.

- يسلط هذا الاختراق الضوء على الثغرات الأمنية في منصات الذكاء الاصطناعي، خاصةً فيما يتعلق بالتعامل مع بيانات المستخدمين وحمايتها.

- يُزعم أيضًا أن المخترق حصل على معلومات الفواتير وبيانات الاعتماد، مما يعرض المستخدمين لخطر سرقة الهوية والاحتيال.

- يثير الاختراق مخاوف بشأن أمن خدمات الذكاء الاصطناعي القائمة على السحابة وقدرتها على حماية خصوصية المستخدم.

- لم تؤكد أومني جي بي تي حتى الآن الاختراق أو تعلق على التفاصيل، ولكن الحادثة جذبت اهتمامًا كبيرًا من خبراء الأمن السيبراني.