موارد

أربع خطوات للمواءمة مع إطار عمل المعهد الوطني للمعايير والتكنولوجيا والابتكار والذكاء الاصطناعي باستخدام نظام Skyhigh SSE

بقلم سارانج وارودكار - مدير تسويق المنتجات التقنية في CASB، Skyhigh Security وجون دورونيو - مهندس مبيعات برمجيات, Skyhigh Security

12 ديسمبر 2024 3 قراءة دقيقة

مع تحول الذكاء الاصطناعي والنماذج اللغوية الكبيرة (LLMs) إلى أعمال تجارية، فإنها تجلب معها فرصًا ومخاطر في آنٍ واحد. في حين أن الذكاء الاصطناعي يقود الكفاءة والابتكار، إلا أنه يفرض أيضًا تحديات مثل انتهاكات البيانات، وانتهاكات الامتثال، واستخدام الذكاء الاصطناعي الخفي. إن الاعتماد السريع للذكاء الاصطناعي غالبًا ما يفوق الحوكمة، مما يجعل المؤسسات عرضة لمخاطر تتعلق بالسمعة والمخاطر المالية والقانونية دون اتخاذ تدابير أمنية مناسبة.

وإدراكًا للأهمية الحاسمة لاعتماد الذكاء الاصطناعي الآمن، أصدر البيت الأبيض مؤخرًا مذكرة الأمن القومي الافتتاحية بشأن الذكاء الاصطناعي، والتي تُلزم جميع الوكالات الفيدرالية الأمريكية بتعيين كبير مسؤولي الذكاء الاصطناعي في غضون 60 يومًا من صدور التوجيه.

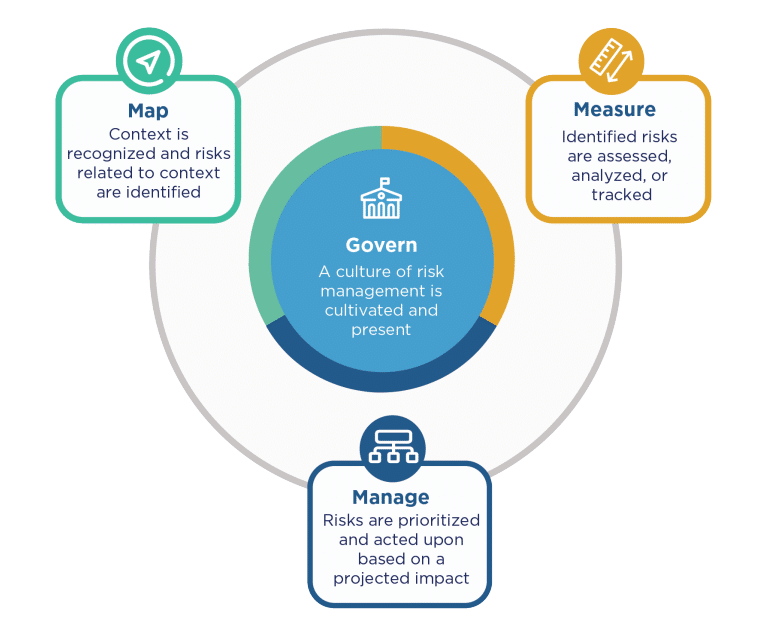

تؤكد هذه المذكرة على الحاجة الملحة إلى إنشاء حوكمة قوية لاستخدام الذكاء الاصطناعي لمنع مخاطر الأمن السيبراني وضمان الامتثال. Skyhigh Security في طليعة من يلبي هذه الاحتياجات من خلال منصة Secure Service Edge (SSE) التي تتميز بحل Skyhigh AI، وهو حل متقدم لإدارة أمن الذكاء الاصطناعي. يتماشى حل Skyhigh AI بسلاسة مع إطار عمل إدارة مخاطر الذكاء الاصطناعي (AI RMF 1.0) التابع للمعهد الوطني للمعايير والتكنولوجيا (NIST)، حيث يقدم نهجًا منظمًا لإدارة مخاطر الذكاء الاصطناعي عبر أربع وظائف أساسية: رسم الخرائط والقياس والإدارة والحوكمة.

دعنا نتعمق في كيفية مساعدة Skyhigh AI للمؤسسات على التوافق مع إطار إدارة علاقات الذكاء الاصطناعي NIST وتطبيق ممارسات الذكاء الاصطناعي الآمنة والمسؤولة.

1. الخريطة: تحديد السياق والمخاطر المحتملة

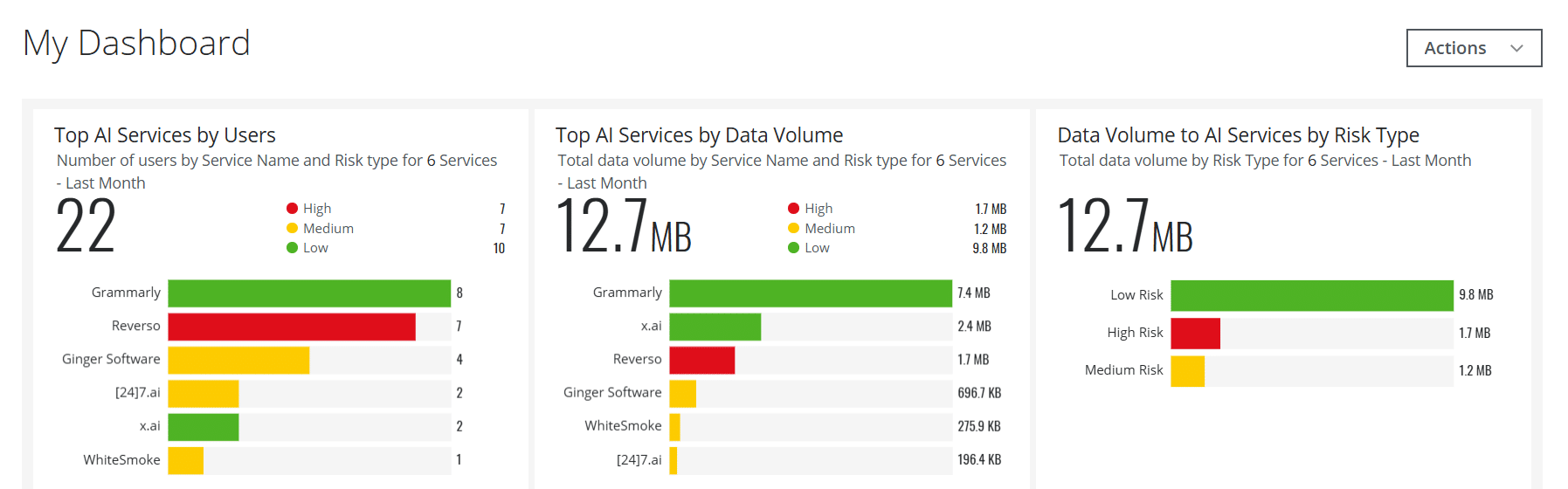

تشدد الوظيفة الأولى من إطار عمل إدارة RMF للذكاء الاصطناعي للمعهد الوطني للمعايير والتكنولوجيا والابتكار على فهم السياق والنطاق وأصحاب المصلحة المشاركين في نظام الذكاء الاصطناعي. تتفوق Skyhigh AI، التي تم إطلاقها في مؤتمر RSA 2024، في هذا المجال من خلال تقديم

- إمكانية رؤية شاملة لتطبيقات الذكاء الاصطناعي الخاصة والمُجازة، والخفية والخاصة.

- دعم أكثر من 1,100 تطبيق للذكاء الاصطناعي عبر السجل السحابي Skyhigh Cloud Registry.

- أكثر من 75 سمة من سمات المخاطر بما في ذلك السمات الخاصة بالذكاء الاصطناعي

توفر هذه القدرة على رسم الخرائط للمؤسسات فهماً متعمقاً لمنظومة الذكاء الاصطناعي الخاصة بها، مما يمكّنها من تحديد المخاطر المرتبطة باستخدام تطبيقات الذكاء الاصطناعي في الوقت الفعلي تقريباً والتخفيف من الانتهاكات المحتملة للبيانات.

2. التدبير: تقييم وتحليل المخاطر

بمجرد تعيين النظام البيئي للذكاء الاصطناعي، يجب على المؤسسات تقييم المخاطر وتحديدها. تقدم Skyhigh AI أدوات قوية لتقييم أمن أنظمة الذكاء الاصطناعي منخفضة المخاطر، بما في ذلك:

- سمات الأمان لتطبيقات الذكاء الاصطناعي

- سمات المخاطر المستندة إلى LLM، مثل إمكانية الاختراق، والسمية، والتحيز، وتوليد البرمجيات الخبيثة

- تصنيف مخاطر المستخدم القائم على التعلم الآلي لتحديد المستخدمين ذوي المخاطر العالية

تعمل Skyhigh AI على تبسيط عملية التقييم المستمر للمخاطر التي تتطلب عملاً مكثفاً من خلال الاستفادة من الأتمتة لضمان بقاء المؤسسات على اطلاع دائم بالتهديدات الناشئة مع التوافق مع معايير NIST.

3. الإدارة: تنفيذ الضوابط واستراتيجيات التخفيف من المخاطر

تحديد المخاطر وحده غير كافٍ. تركز وظيفة الإدارة في NIST AI RMF على تنفيذ ضوابط فعالة للتخفيف من المخاطر ذات الأولوية العالية. وتوفر Skyhigh AI، المدمجة مع Secure Web Gateway وCASB المعتمدين من FedRAMP High المعتمدين من FedRAMP، ما يلي:

- الضوابط المستندة إلى الحوكمة لإدارة تطبيقات الذكاء الاصطناعي مثل حظر التطبيقات، وضوابط الأنشطة

- خيارات لتعطيل سجل الدردشة لـ ChatGPT، مما يمنع استخدام البيانات التنظيمية كبيانات تدريب

- فرض حدود الأحرف وحظر الروابط المشتركة داخل تطبيقات الدردشة

- متقدم Data Loss Prevention (DLP) لحماية البيانات المهمة التي يتم تحميلها إلى تطبيقات الذكاء الاصطناعي مع إمكانات EDM و OCR

تعمل هذه التدابير على تمكين المؤسسات من التخفيف من المخاطر بشكل استباقي مع تعزيز الإنتاجية والابتكار.

4. الحوكمة: إرساء الرقابة والتحسين المستمر

الحوكمة والتحسين المستمر ضروريان لاعتماد الذكاء الاصطناعي المستدام. تدعم Skyhighigh AI ذلك من خلال:

- المراقبة المستمرة لاستخدام الذكاء الاصطناعي في الظل

- التحليل الآلي للمخاطر لضمان الامتثال للوائح التنظيمية المتطورة

- مساعد DLP مساعد DLP مدعوم بالذكاء الاصطناعي لإنشاء سياسة بدون تعليمات برمجية وتقليل الأخطاء وتعزيز الأمان

- الحد من النتائج الإيجابية الكاذبة القائمة على التعلم الآلي وتقليل الإرهاق الناتج عن التنبيهات من أجل تحقيق الكفاءة التشغيلية

تُمكِّن هذه الميزات المؤسسات من إنشاء آليات رقابية قوية، مما يضمن التحسينات المستمرة في ممارسات إدارة مخاطر الذكاء الاصطناعي.

الخاتمة: سكاي هاي للذكاء الاصطناعي - شريك موثوق به في إدارة مخاطر الذكاء الاصطناعي

توفر Skyhigh AI رؤية واضحة لتطبيقات الذكاء الاصطناعي، وفهم المخاطر بما في ذلك سمات المخاطر القائمة على LLM، وDLP على البيانات التي تذهب إلى تطبيقات الذكاء الاصطناعي، والتحقيق في التهديدات وUEBA على تطبيقات الذكاء الاصطناعي.

يتماشى هذا النهج الشامل للذكاء الاصطناعي من Skyhigh مع إطار عمل المعهد الوطني للمعايير والتكنولوجيا والابتكار. ومن خلال معالجة الوظائف الأساسية لإطار العمل - الخريطةوالقياس والإدارة والحوكمة -تزودSkyhighAI المؤسسات بتجهيز المؤسسات للاستفادة من الإمكانات التحويلية للذكاء الاصطناعي مع الحماية من المخاطر المرتبطة به. مع استمرار تطور الذكاء الاصطناعي، تظل Skyhigh AI شريكًا موثوقًا به في تمكين تبني الذكاء الاصطناعي الآمن والمسؤول والمبتكر.

العودة إلى المدوناتمضامين ذات صلة

المدونات الرائجة

Skyhigh Security Renews IRAP Assessment at PROTECTED Level for 2026

Sarang Warudkar and Stuart Bayliss May 21, 2026

The Browser Security Gap Enterprises Can No Longer Ignore

Sarang Warudkar May 19, 2026

Securing the Fragmentation of the Modern Enterprise: The Data Hosting Conundrum

Ste Nadin May 14, 2026

Skyhigh Security Achieves SOC 2 Type II Compliance for the Complete SSE Cloud Platform

Sarang Warudkar and Stuart Bayliss April 30, 2026

Resilient Web Access Infrastructure: Business Imperative in a Cloud and Vibe-Code Obsessed World

Nick LeBrun April 23, 2026